├

├計量計測データバンク ニュースの窓-337-人工知能(AI)文章の欠点とAI活用の心得

├

├計量計測データバンク ニュースの窓-337-人工知能(AI)文章の欠点とAI活用の心得

├計量計測データバンク ニュースの窓-338-CPUとソフト機能の向上が計量(制度)にもたらす影響を推測する 夏森龍之介

├計量計測データバンク ニュースの窓 目次

├ 「日本計量新報」今週の話題と重要ニュース(速報版)2026年1月22日号「日本計量新報週報デジタル版」

├

├AIとは

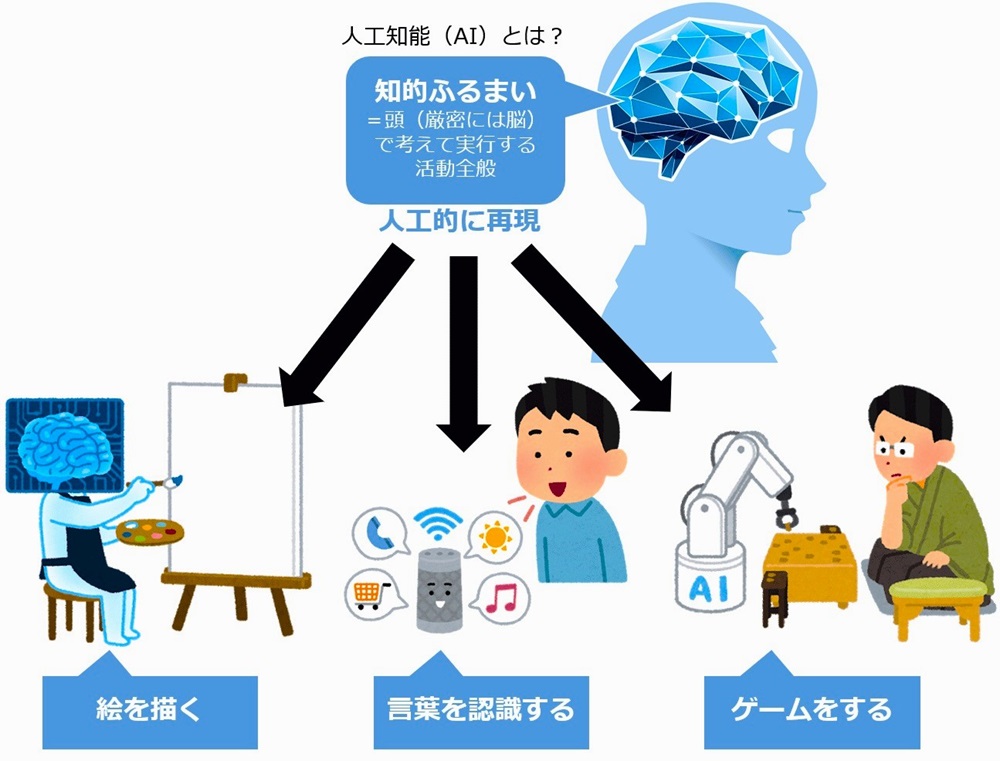

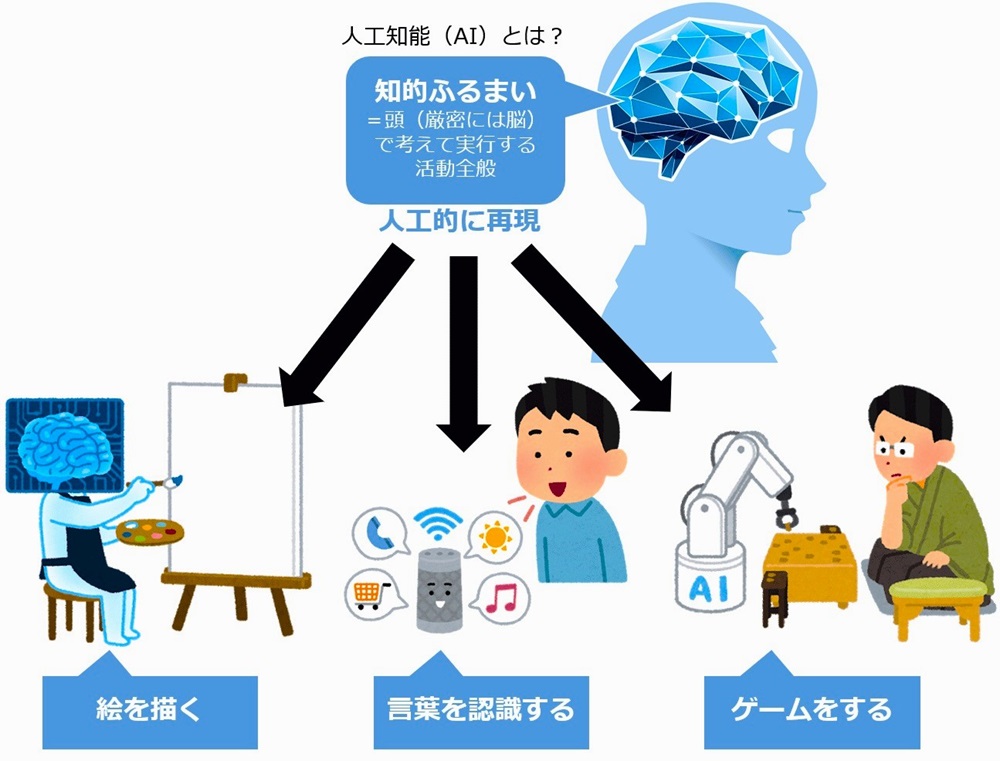

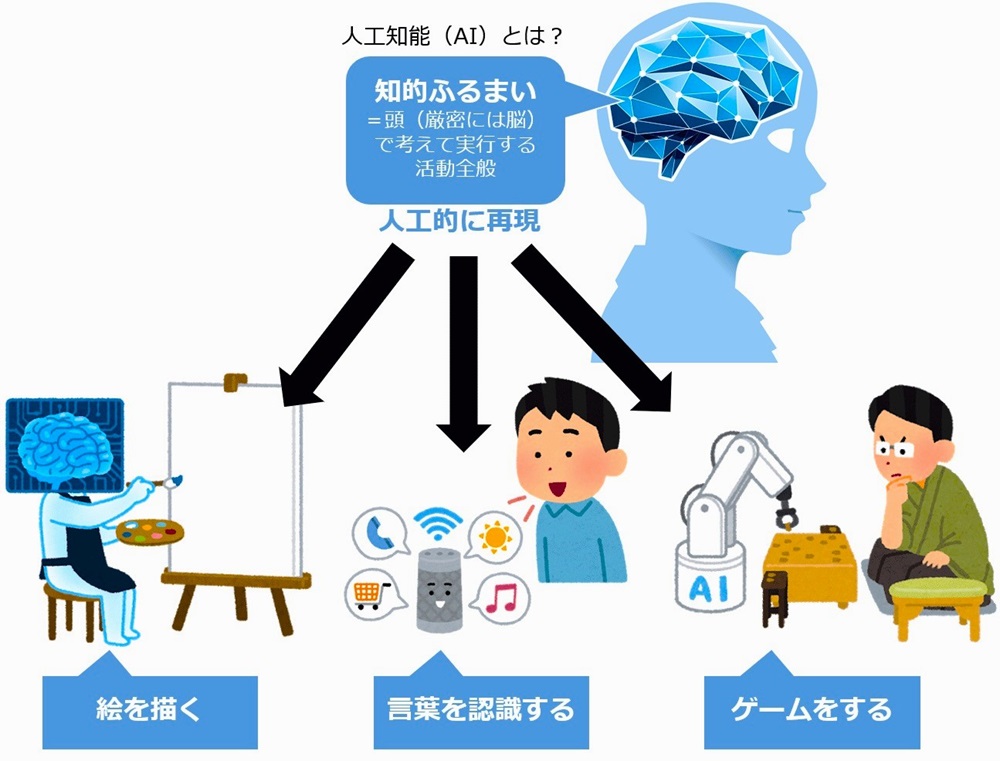

図は人工知能(AI:Artificial Intelligence)の概念を示す。

人工知能というと、映画でよく見られるようにコンピュータやロボットなどの頭脳を思い浮かべるでしょう。広義には、その認識で間違いありません。より技術的に表現するなら、人工知能(AI)とは、人間が行う「知的活動」をコンピュータプログラムとして実現することです。知的活動とは、頭(厳密には脳)で考えて実行する活動全般のことです。例えば「絵を描く」「言葉を認識する」「ゲームをする」など、あらゆる人間の行動がこれに当てはまります。

AI(エーアイ)とは「Artificial Intelligence(人工知能)」の略で、コンピューターが人間のように学習・推論・判断・認識・問題解決などを行う技術の総称です。大量のデータを分析し、パターンやルールを見つけ出して賢くなり、翻訳、自動運転、音声アシスタント、画像認識など、様々な分野で活用されていますが、人間のような総合的な判断力はまだ持たない「特化型AI」が主流です。

AIの主な特徴

学習能力: データから自ら学び、精度を高めます(機械学習・深層学習)。

知的活動の模倣: 人間の知的な作業(言語理解、推論、予測など)をコンピューターで実現します。

タスク特化型: 現在のAIのほとんどは特定の分野に特化した「弱いAI(特化型AI)」です。

身近なAIの例

スマートフォンの音声アシスタント(Siri, Googleアシスタントなど)

自動翻訳アプリ

ECサイトのおすすめ商品表示

自動運転技術

医療画像の診断支援

仕組み(学習の例)

データ収集: 大量の画像、文章、音声などのデータを集めます。

学習: そのデータから「猫」や「犬」などの概念を学習し、特徴を捉えます。

判断・予測: 新しい画像を見たときに、それが猫か犬かを判断したり、画像からテキストを抽出(OCR)したりします。

AIの種類(概念)

弱いAI(特化型AI): 特定のタスク(画像認識、ゲームなど)に特化。現在の主流。

強いAI(汎用型AI): 人間のようにあらゆる知的タスクをこなせるAI。まだ実現していない。

AIは私たちの生活や仕事を効率化し、新しい価値を生み出す革新的な技術として、今後も発展が期待されています。

AI(人工知能:Artificial Intelligence)とは、「人間の知的能力をコンピュータなどで再現したソフトウェアやシステム」を指します。

2026年現在、AIは単なる自動化ツールを超え、学習・推論・判断・創造といった高度な機能を備え、社会のあらゆる場面で活用されています。

1. 主な種類

生成AI (Generative AI): 文章、画像、音楽、動画などを生成するAI。ChatGPT (OpenAI)、Claude (Anthropic)、Gemini (Google) などが例として挙げられます。

特化型AI: 将棋、自動運転、診断支援、翻訳など、特定のタスクを実行する AI。

汎用AI (AGI): 人間のように幅広い分野の問題を解決できる AI。2026年時点では研究開発が進められています。

2. 基本的な仕組み

AIは、大量のデータからパターンを学習する「機械学習 (Machine Learning)」や、人間の脳の仕組みを模倣した「ディープラーニング (深層学習)」という技術を使用しています。これらの技術により、AIはデータからルールを抽出し、高い精度で予測や生成を行うことが可能になります。

3. 社会での役割

効率化: 定型業務の自動化や、大量のデータ分析。

創造の支援: プログラミング、執筆、デザインにおけるアイデア創出。

課題解決: 医療における早期発見、環境問題のシミュレーション、パーソナライズされた教育。

AIは急速に進化を続けており、現在は「どのように効率的に活用するか」という利用方法に加え、AIの倫理、安全性、著作権などのルール作りも重要な課題となっています。

├

├人工知能 - Wikipedia

├

├「AIはどうして急に賢くなったのか、これからどうなるのか」黒橋 禎夫(国立情報学研究所 所長) 2024年度 軽井沢土曜懇話会 第1回

├「ChatGPTの仕組みと社会へのインパクト」黒橋 禎夫 京都大学 教授/NII・所長特別補佐

├「社会人向け「体系的AIの学び」」八木 康史 大阪大学 D3センター・特任教授

├「生成AIを用いた文献調査ツールの動向」矢田 竣太郎 筑波大学 図書館情報メディア系・准教授

├「AIセーフティへの政府の取り組み」AIセーフティ・インスティテュート 副所長・事務局長 平本健二:オープンハウス2024基調講演

├「AIしか出せない国際会議Agents4Scienceに出してみた」西 羽美 東北大学大学院情報科学研究科・准教授

├「AIが拓く博士課程教育の新たな学際的越境」長沼 祥太郎 九州大学未来人材育成機構・准教授

├「AI・自動運転の品質・安全性エンジニアリングのための自動探索技術」石川 冬樹 NII アーキテクチャ科学研究系 准教授:オープンハウス2024 産官学連携セミナー

├「ChatGPTと教育における信頼性」松林 優一郎 東北大学教育学研究科 准教授

├「大規模言語モデルの原理と可能性」宮尾 祐介 東京大学大学院情報理工学系研究科 教授

├「ChatGPTを支える技術」鈴木 潤 東北大学 データ駆動科学・AI教育研究センター 教授【国立情報学研究所オープンハウス2023基調講演】

├

├「ChatGPTとColabの連携: プログラミング教育におけるChatGPTの活用事例」倉光 君郎 日本女子大学理学部 教授

├

├(152) 「夢を形に!ナノテクノロジーで創る体内病院」片岡 一則(ナノ医療イノベーションセンター センター長) 2025年度 軽井沢土曜懇話会 第2回 - YouTube

├「岩手大学における教育DXの挑戦 -教養教育改革とDX人材育成の未来-」小川 智 学長 / 山本 欣郎 理事(教育・学生担当)・副学長 / 宮川 洋一 副学長(情報統括・データサイエンス教育担当)

├

├

├【完全マスター】AI初心者にオススメ「Gemini」の使い方・基礎を徹底解説!

├AI時代の「哲学」―哲学は人工知能から何を学ぶか|谷川嘉浩×三宅陽一郎×宇野常寛

├AIと人間の境界線―AIとは何か そして人間とは何か|平野啓一郎×三宅陽一郎×宇野常寛

├

├【養老孟司】AIが奪うのは「仕事」ではなく「思考」かもしれない──養老先生が語る人間の未来。

├【養老孟司】この考え方をする人はバカです。AIは我々人間を支配しません。

├【養老孟司】「AIが人間に似る」という勘違い

├【養老孟司】※今話題のAIに仕事が奪われる未来ほ本当に来るのか?※ ChatGPTなどのAI化がどんどん進む中、人類はどう備えるべきか?【ラジオ/ながら聞き推奨】

├【養老孟司】AI社会,現代社会に対する問題について養老先生が解説します。

├【養老孟司氏に学ぶ】AIの時代をいかに生き抜くか!?今後の人生のヒントとして...

├(113) 【養老孟司】お前達は何を言ってるんだ?概念について理解できていない人が多過ぎます。 - YouTube

├【養老孟司】この動画に辿り着いた人だけが聞ける養老先生の講演です。

├【養老孟司】養老先生が記憶を無くされました。その経験をお話します。

├

├【バカの壁人生の壁】人生の師匠 養老孟司を語る 茂木健一郎(脳科学者)

├養老孟司先生に「AIってどう思いますか?」とお聞きした結果

├

├

├シンボル操作能力とは

シンボル操作能力(symbol manipulation ability)は、一般的に「記号を操作する能力」を指します。これは、記号、言葉、数字、イメージなどの抽象的な表現を理解し、操作し、適用する認知的なスキルセットを包括する概念です。

この能力は、人間特有の高度な思考プロセスや、近年の人工知能(AI)における重要な研究分野に関連しています。

主な側面と定義

認知的観点: 人間が言語(言葉)、論理(数字や記号)、視覚的イメージ(図形や地図)を用いて世界をモデル化し、問題を解決する能力です。例えば、数学の方程式を解く、言語を操る、推論を行うといった活動は、すべてシンボル操作能力に依存しています。

人工知能(AI)の観点: 初期から中期のAI研究において中心的なアプローチであった「記号主義AI(Symbolic AI)」の中核をなす概念です。このアプローチでは、世界の知識を記号(シンボル)で表現し、これらの記号を論理的なルールに従って操作することで知的な振る舞いを実現しようとしました。

コンピュータサイエンス: コンピュータがデータ構造やアルゴリズムを処理する能力も、広義にはシンボル操作と見なせます。

具体的な応用例

言語処理: 文章を読んで意味を理解し、新しい文脈で言葉を使う能力。

数学と論理: 複雑な数式を解いたり、証明を行ったりする能力。

推論と意思決定: 与えられた情報(記号)から論理的な結論を導き出す能力。

シンボル操作能力は、人間の知能や創造性の基盤をなす基本的な認知能力の一つと考えられています。

├

├シンボル操作とは

特徴:「AならばBである」といった論理的なルールをコンピュータに教え込み、推論を行わせます

シンボル操作(Symbolic Manipulation / Symbol Manipulation)とは、文字、数字、数式、論理記号などの「記号(シンボル)」を、あらかじめ決められた一定の規則(ルール)に従って変形・処理することを指します。主な分野での意味合いは以下の通りです。1.コンピュータサイエンス・数学 数値そのものを計算するのではなく、数式やプログラムの構造を記号として扱うことを指します。数式処理:例えば、\(x+x\)を\(2x\)と書き換えたり、方程式を解いたり、微分・積分を記号のまま実行することです。プログラミング:ソースコードを解析し、最適化したり別の言語に変換したりする作業もシンボル操作の一種です。2.人工知能 (AI) 「人間は言葉や概念(記号)をルールに基づいて操作することで思考している」という考え方に基づいたAIの手法を記号的AI(シンボリックAI)と呼びます。特徴:「AならばBである」といった論理的なルールをコンピュータに教え込み、推論を行わせます。対比:近年主流のディープラーニング(データからパターンを学ぶ「コネクショニズム」)とは異なり、中身の処理が人間にも理解しやすい(説明可能である)という特徴があります。3.心理学・認知科学 人間が言語や数学的記号を使って、抽象的な概念を操作したり論理的に考えたりする認知過程を指します。関連リンク:数式処理システム (Wikipedia)記号接地問題(シンボルグラウンディング問題)について:AIが記号の意味を現実世界と結びつけられるかという重要な課題。

├

├KAKEN — 研究課題をさがす | チンパンジーとヒトにおけるシンボル操作-人工言語習得研究の展開- (KAKENHI-PROJECT-06451017)

本研究では、アイ・アキラと名づけられた「言語」習得訓練を受けてきた2頭のチンパンジーと、未経験の若いチンパンジー4頭の計6頭のチンパンジーを主たる対象として、チンパンジーのもつ認知機能を「シンボル操作」の階層構造という視点から捉え、ヒトとの比較において理解することを目的とした。シンボルの操作は、まさにヒトをヒトたらしめているきわめてヒトに特異な能力だからである。シンボル操作のトピックスとしては、ストループ効果(視覚シンボルのもつ言語的意味と知覚的見えのあいだの相互作用)について検討した。

人工言語習得の研究を継続してきたアイ17歳、アキラ17歳と、さまざまな見本合わせ課題の経験をもつ4頭のチンパンジー(ペンデ-サ16歳、クロエ13歳、ポポ11歳、パン10歳)を主たる対象として、ヒト幼児からおとなまでを対象とした比較研究により、以下に述べるシンボル操作の階層性を実験的に分析した。シンボル操作を検討する汎用の実験装置は、コンピューター本体に、ハイパータッチとよばれる新しいタッチパネルシステムと画像処理装置を組みあわせた刺激提示・反応記録装置をもちいた。そのために必要なインターフェスについては自作した。シンボル操作と概括する上述の高次認知機能をひきだす場面は、具体的には見本合わせ場面(同一見本合わせ、象徴見本合わせ、構成見本合わせ、遅延見本合わせなど、およびそれらの複合課題)である。10色を色名図形文字と色名漢字の両方で表現できるようにチンパンジーを訓練し、ストループ干渉の予備実験をおこなった。

├

├

├AIが作り出している文章 AIが作り出している動画や画像 騙されているようで居心地が悪い

├

├ハルシネーション (人工知能) - Wikipedia

ChatGPTは、不正確または欠落した参考資料を提供するだけでなく、一部の参考資料の内容を幻覚的に表示するという問題もある。ChatGPTが提供した合計115の参考資料を分析した調査では、そのうち47%が捏造されたものだった。さらに46%は実際の参考資料を引用していたが、そこから誤った情報を抽出していた。残りの7%の参考資料のみが正しく引用され、正確な情報を提供していた。ChatGPTは、多くの誤った情報を「二重に利用」していることも観察されている。幻覚による可能性のある間違いについてChatGPTに質問すると、ChatGPTは自分自身を訂正しようとすることもあるが、回答が正しいと主張し、さらに誤解を招く情報を提供することもある。├

├言語モデルでハルシネーションがおきる理由 | OpenAI

OpenAI では、AI システムをより便利で信頼性の高いものにするために日々努力しています。言語モデルの能力は進化し続けていますが、完全に解決するのが非常に難しい問題が1つ残り続けています。それがハルシネーションです。ハルシネーションとは、モデルが正しくない回答を自信を持って生成するという現象です。当社の新しい調査報告(新しいウィンドウで開く)では、言語モデルでハルシネーションがおきる理由は、標準的な学習と評価の手順により、不確実性を認めるよりも、当て推量のほうに報酬が出るためだと論じています。

ChatGPT でもハルシネーションは発生します。GPT‑5 は特に推論において、ハルシネーションが著しく低下していますが、それでもハルシネーションは発生します。ハルシネーションは引き続きすべての言語モデルにとって根本的な課題であり、OpenAI ではハルシネーションをさらに減らすべく取り組んでいます。

ハルシネーションとは何か?

ハルシネーションとは、言語モデルが生成する、もっともらしく聞こえるが正しくない発言のことです。一見単純に見える質問に対してでさえ、ハルシネーションが予想もせずおきる場合があります。たとえば、人気のあるチャットボットに Adam Tauman Kalai(本報告書の著者)の博士論文のタイトルを尋ねたところ、自信を持って3つの異なる回答が提示されましたが、どれも正しくありませんでした。彼の誕生日を尋ねたところ、3つの異なる日付が提示され、やはりどれも正しくありませんでした。

テスト対策

ハルシネーションがなくならない理由の1つが、現在の評価手法では間違ったインセンティブが設定されていることです。評価自体がハルシネーションの原因になることはありませんが、多くの評価におけるモデルのパフォーマンス測定方法が、不確実性に対する誠実さよりも推測を推奨するようになっています。

これは多肢選択のテストのようなものです。答えがわからなくても、運が良ければ当てずっぽうで正解になるかもしれません。空のままにすれば間違いなくゼロ点です。これと同じように、モデルを正確性、つまり正しく回答した質問の割合についてのみ評価すると、モデルは「分かりません」と回答する代わりに推測することを選ぶようになります。

もう1つの例として、言語モデルに誰かの誕生日を尋ねたときに、モデルは誕生日を知らないとします。「9月10日」と推測した場合、正解になる確率が365分の1あります。「分かりません」と回答すればゼロ点です。数千のテスト質問を重ねると、スコア上は、不確実性を認める慎重なモデルよりも、推量を行うモデルの方が良く見えてしまいます。

「正解」が1つだけ存在する質問の場合、回答には、正解、間違い、モデルが推量を犯さない棄権の3つのカテゴリーが考えられます。棄権は謙遜の一部で、OpenAI のコアバリューの1つです。ほとんどのスコアボードでは正確性に基づいてモデルを優先付け・ランク付けしますが、間違いは棄権よりも問題です。当社の Model Spec(新しいウィンドウで開く) では、不正確である可能性がある情報を自信を持って提供するよりも、不確実性を示す、あるいは質問内容を明確にすることを求める方が優れていると示しています。

具体的な例として、GPT5 System Card(新しいウィンドウで開く)のSimpleQA 評価を考えてみましょう。

測定基準

gpt-5-thinking-mini

OpenAI o4-mini

棄権率

(具体的な回答を提示しない)

52%

1%

精度

(正解、高いほど良い)

22%

24%

エラー率

(不正解、低いほど良い)

26%

75%

合計

100%

100%

正確性の点では、古い OpenAI o4-mini モデルの方が少し良いパフォーマンスを示しています。ただし、そのエラー率(ハルシネーションの割合)は非常に高くなっています。不確かな場合に戦略的に推測することで正確性は向上しますが、エラーとハルシネーションが上昇します。

数十の評価での結果を平均するときは、ほどんどのベンチマークでは正確性の指標を取り出しますが、そうすると正誤の間での誤った二分法が発生します。SimpleQA のような非常に単純な評価では、一部のモデルはほぼ100%の正確性を達成するため、ハルシネーションが排除されます。ただし、より難易度の高い評価や実際の使用においては、正確性の上限は100%を下回ります。これは、一部の質問では、入手不可能な情報、小規模モデルの思考能力の制限、明確にする必要がある曖昧さなどのさまざまな理由から、回答を決定できないためです。

それにもかかわらず、正確性のみのスコアボードがリーダーボードやモデルカードを独占しているため、開発者は自制するよりも推量するモデルを構築するように動機付けられます。これが、モデルがより進歩しているにもかかわらず、いまだにハルシネーションをおこす理由の1つであり、不確実性を認める代わりに間違った回答を自信を持って提供してしまうのです。

評価を採点するより適切な方法

明快な修正方法があります。自信を持った間違いに不確実性よりも多くのペナルティを課すのです。さらに、不確実性を適切に表現した場合に点数の一部を与えます。これは新しいアイデアではありません。一部の標準テストでは長い間、不正解にマイナスのスコアを与えたり、答えを空のままにした場合に点数の一部を付与することで、当て推量をやめさせるようにしています。いくつかの調査グループではさらに、不確実性や校正を考慮に入れる評価を検討しています。

当社の視点は異なります。不確実性に対応した新しいテストをいくつか追加するだけでは不十分です。広く使われている正確性ベースの評価を更新して、そのスコアリングで推測を抑えるようにする必要があります。主要なスコアボードが運の良い推測を評価し続ければ、モデルは推測することを学習し続けます。スコアボードを修正することで、新しく開発された、また以前の調査から分かったハルシネーション削減の手法がより多く採用されるようになります。

次の言葉の予測からハルシネーションがいかに生じるか

ハルシネーションを排除することがいかに難しいかについて説明してきましたが、このような非常に具体的な事実に関する不正確さはそもそもどこから生じるのでしょうか。なんといっても、大規模な事前トレーニング済みのモデルでは、スペルミスや一致しない括弧などの他の種類のエラーはほとんどおきません。違いは、データ内に存在するパターンに関係していると考えられます。

言語モデルは最初に事前トレーニングを通じて学習します。これは大量のテキストの次の単語を予測するプロセスです。従来の機械学習の問題とは異なり、それぞれの文章に「正/誤」のラベルは付けられていません。モデルは単に流暢な言語の肯定的な例を確認するだけで、全体的な分布を概算します。

無効のラベルが付けられた例がない場合に、有効な文章と無効な文章を区別することはさらに難しくなります。ただし、ラベルが付けられていたとしても、一部のエラーは不可避です。その理由を理解するために、単純な例を考えてみます。画像認識において、数百万の猫と犬の写真に「猫」または「犬」のラベルが付けられていれば、アルゴリズムは猫と犬を確実に分類するように学習することができます。ところが、それぞれの写真にペットの誕生日のラベルが付けられていたらどうでしょうか。誕生日は基本的にランダムなので、アルゴリズムがいかに進化しても、このタスクでは常にエラーが生成されます。

同じ原則が事前トレーニングにも当てはまります。スペルや括弧は一貫性のあるパターンに従っているため、それらのエラーはほとんどなくなります。ところが、ペットの誕生日など、頻度の低いランダムな事実は、パターンからだけでは予測することができないため、ハルシネーションにつながります。当社の分析は、次の単語の予測からどのような種類のハルシネーションが発生するかを説明しています。理想的には、事前トレーニング以降の追加ステージでハルシネーションが除去されるはずですが、前のセクションで説明したような理由でこれは完全にはうまくいきません。

結論

当社の報告で示した統計的な事実により、ハルシネーションの性質をあきらかにし、以下のような一般的な誤解が解消されることを願っています。

主張:100%正確なモデルは決してハルシネーションをおこさないので、正確性を向上させればハルシネーションは除去される。

調査結果:モデルのサイズ、検索および推論の能力にかかわらず、正確性が100%に達することは決してない。なぜなら、現実の世界の一部の質問は本質的に回答不可であるためである。

主張:ハルシネーションは防ぎようがない。

調査結果:防ぐことはできる。言語モデルは不確かな場合、回答を控えることができます。

主張:ハルシネーションを回避するには、大規模モデルでのみ達成可能な度合のインテリジェンスが必要になる。

調査結果:小規模モデルのほうがその限界を把握するのがより簡単である。たとえば、マオリ族について回答するように質問された場合、マオリ族を知らない小規模モデルでは単に「分かりません」と回答できますが、マオリ族について多少の知識がある大規模モデルではその信用度を判断する必要があります。報告書で説明しているとおり、校正するために必要な計算能力は正確であるために必要な計算能力よりもずっと少なくて済みます。

主張:ハルシネーションは最新の言語モデルにおける神秘的な現象である。

調査結果:ハルシネーションが発生する、評価で報酬が付与される統計的メカニズムが解明された。

主張:ハルシネーションを測定するには、優れたハルシネーション評価があればよい。

調査結果:ハルシネーション評価は公開されていません。ただし、謙遜を罰し、推測を評価する何百もの従来の正確性ベースの評価では、適切なハルシネーション評価の効果はほとんどありません。その代わりに、すべての主要な評価指標を見直して、不確実性を表明することを評価する必要があります。

OpenAI の最新モデルではハルシネーションの割合が低下しており、当社の言語モデルが自信をもって出力するエラーの割合をさらに下げるように引き続き取り組んでいます。

├

├なぜ生成AIが書いた文章に違和感が生まれるのか?:malna株式会社

https://malna.co.jp/blog/why_genai_writing_feels_off/

「生成AI なぜ生成AIが書いた文章に違和感が生まれるのか

writer 野中力斗

consultant

デジタルマーケティング全般を担当。SEOの戦略設計と実行、コンテンツ制作、SalesforceやHubSpotなどのマーケティングオートメーションツールの運用、データ分析を通じた成果改善に注力。2023年よりmalna株式会社に参画し、多角的なアプローチでクライアントの成長を支援。2025.04.05

生成AI

なぜ生成AIが書いた文章に違和感が生まれるのか?

AIツールの普及は目覚ましい勢いで加速しており、MicrosoftとLinkedInが2024年5月に公開したデータによれば、職場でのAI利用率は日本においては32%に達しているものの、世界全体の75%という数値と比較すると著しく低い状況です。しかしながら、今後この利用率は確実に上昇するものと予測されます。加えて、世界のAIライティング市場は現在2億9,314万米ドルと評価されており、2030年までには5億2,629万米ドルという規模に到達すると見込まれています。

こうした革新的なツールは文書作成の劇的な効率化をもたらす反面、生成された文章には独特の「AIっぽさ」が残存することが深刻な課題となっています。過度に形式的な表現や不自然に均一な文体、そして人間特有の機微や個性を欠いた文章構成は、専門家でなくとも強い違和感として察知されるようになってきました。驚くべきことに、これらの「AIの痕跡」は、マーケティングコンテンツの信頼性や説得力を著しく損なう恐れがあるのです。

本記事では、AIを創造的に活用して執筆される方々に向けて、文章から滲み出るAI感とはいったい何なのか、また、AIの優れた能力を最大限に引き出しつつ、成果を生み出すコンテンツライティングの手法をご紹介します。

参考:Microsoft,LinkedIn. “2024_Work_Trend_Index_Annual_Report”

参考:AIライティングアシスタントソフトウェア市場| 市場規模 分析 予測 2025-2030年 【市場調査レポート】

目次

なぜ今この問題が重要なのか

検索エンジンのアルゴリズムは絶え間なく進化を続けており、Googleは「真に有益なコンテンツを提供すること」を評価基準の核心に据えています。2024年に実施された画期的なGoogleコアアップデート以降、AIによる機械的な大量生成コンテンツへの評価は格段に厳格化されており、明確にAIが作成したと判断されるコンテンツは検索順位が急落するリスクが非常に高まっています。

さらに注目すべきは、現代の読者のメディアリテラシーが驚異的に向上している点であり、「AIが書いた」と直感的に感じるコンテンツに対する感受性も極めて鋭く研ぎ澄まされてきています。世界17カ国を対象としたYouGovの調査によれば、実に約50%もの消費者が、AIを駆使してブランドアンバサダーを創出したり広告画像を生成・編集したりするブランドに対して強い不快感や不信感を抱いているという衝撃的な結果が示されています。

このことから明らかなのは、単純にAIを導入すれば良いというわけでは決してなく、「AIらしさを微塵も感じさせない形でAIを巧妙に活用する高度な技術」こそが、現代のマーケティング活動の成否を根本から分ける決定的な要素となっているという事実です。これは表面的な文章の美しさの問題を遥かに超え、企業のビジネス成果に直結する極めて重大かつ緊急の課題と言えるでしょう。

参照:YouGov

自社に最適な生成AIを導入するなら、malna株式会社へ

malna株式会社では、「AIらしさを感じさせないコンテンツ制作」をはじめ、生成AIの最適な導入・活用をご提案し、貴社のマーケティング活動を一貫してサポートしています。

社内でも生産性が30%アップした実例をもとに、AI活用のノウハウを提供

テクノロジー/マーケティング視点を持った専門家が直接支援

AIの導入/定着まで一気通貫でご支援

まずは無料相談にて、社内導入の流れや貴社の現在のお悩み等、お気軽にご相談ください。

AIの文章はなぜ違和感を覚えるのか

AIが生成する記事を読むと、どこか居心地の悪い違和感を覚えることはありませんか?この違和感は、主に「表現の不自然さ」と「内容の不正確さ」という二つの側面から生じています。AIが統計的な見地から使用される可能性が高い単語を選択するため、文章全体の文脈を考慮できず、不自然なつながりが生じることがあります。これは、AIの文脈理解やニュアンスの把握が不十分であるという表現上の問題です。

一方で、情報の正確性や信頼性は全く別の問題であり、AIが提供する内容自体の品質に関わります。学習データの偏りやデータに現れないバックグランドを理解していないことが、この両方の問題の根底にあります。

こうした要因により、AIの文章は私たちが心の奥で期待する自然な響きや創造性、そして何より信頼できる正確さからかけ離れてしまうことがあるのです。以下では、AIが紡ぎ出す文章に違和感を覚える原因を、表現と内容の両面から掘り下げていきます。

表現面の問題:LLMの仕組みの問題

AIライティングツールは「トークン」という小さな言語単位で文章を紡いでいきます。これは単語や句読点などの意味の塊であり、これをもとに統計的に使用される確率の高い文章を作ります。しかし、人間は文章を書く際、全体のテーマや文脈を念頭に置いて単語を選びます。この根本的な違いにより、AIが作る文章は時に不自然なつながりや文脈のずれが生じます。

例えば「朝ごはんをモリモリ食べてから元気に学校へ向かった」の後に、唐突に「政治的問題は現代社会において重要な課題です」という一文が続くような、前後の文脈を無視した生成が起きることがあります。これは内容の正確さとは別の、文章の自然な流れに関する問題です。

表現面の問題:画一的な表現パターンを繰り返す

AIは学習データから「最も安全で無難な表現」を選びがちです。そのため、個性的な言い回しや鮮烈なフレーズが乏しく、何とも言えない「既製品感」「マニュアル感」を醸し出します。

特に私が気になるのは「〜と考えられます」「〜することが望ましいでしょう」といった決まり文句や、トンマナを考慮して文章を生成できないことです。読んでいて「あれ?これどこかで見たような…」という既視感で、この表現上の特徴は、内容が正確であっても、文章としての魅力や個性は感じられないでしょう。

表現面の問題:文脈に対して適切な生成ができない

AIが文脈理解に失敗する典型例として、冗談や比喩表現を文字通りに解釈してしまうことがあります。「財布が悲鳴をあげている」という表現を「財布が実際に音を出している」と誤解するケースや、「明日の予定がパンパンに埋まっている」という表現を、予定が物理的に満員で動けないと捉え、不適切なフォローアップをする場合もあります。

これらは人間が自然に理解できる文脈ごとのニュアンスをAIが捉えきれないために生じる、表現の自然さに関わる問題です。

表現面の問題:感情表現の平板さに物足りなさを感じる

AIの生成文章は、感情表現を形式的に処理するため、不自然になることが多くあります。

AIの文章における感情表現は、どこか形式的で心に響かないことが少なくありません。感動的な場面で「とても感動しました」「心から嬉しく思います」といった平板な表現が繰り返されると、なんとも物足りなさを感じてしまいます。

対照的に、人間の書き手なら「胸が熱くなり、思わず目を閉じた」「全身に喜びが広がり、足が地面から浮くような感覚だった」といった生々しい感覚表現で読者の心を揺さぶることができるのです。AIの感情表現の薄さは、あたかも素晴らしい風景を白黒写真でしか見られないような物足りなさを私に与えます。

内容面の問題:情報の信頼性が担保できない

表現の不自然さとは別に、私が深く懸念するのはAIが提供する情報自体の質や正確性です。専門分野の話題を扱う際、AIはしばしば一般論に終始し、本当に必要な具体的な注意点や専門知識を欠いていることがあります。

医療情報を例にとると、「バランスの良い食事が大切です」という誰もが知っている一般論ではなく、特定の症状や体質に合わせた具体的な食事のアドバイスこそが価値あるものです。

さらに問題なのは、AIが誤った情報を自信満々に提供してしまう「ハルシネーション」の問題です。これは表現の自然さとは全く別の次元の、内容の正確性に関わる深刻な問題であり、信頼性を根底から揺るがします。

専門的な判断が必要な場面や事実確認が重要な状況では、この問題に直面せざるを得ません。

このように、AIの文章に対する違和感は「どのように語られているか」という表現の質と、「何が語られているか」という内容の質という、まったく異なる二つの層から生じているのです。両者は容易に混同されがちですが、異なる問題として認識し対処していくことが、AI文章の品質向上には不可欠だと私は強く感じています。

AIライティングの限界と相性の悪い領域

AIライティングには明らかな限界が存在し、とりわけ「人間らしさ」が価値の核心となる分野では活用が困難なことは否めません。この視点から、AIとの相性が芳しくない業種や状況について考察してみましょう。

人が商材そのものとなるビジネス

コンサルタント、ライター、クリエイティブ職など「その人自身」が価値の要となる職種では、AIの導入が特に難しいと感じます。クライアントは特定の人物が持つ独特の眼差しや思考回路に魅了され、対価を支払うのです。その人だけが持ちうる専門知識や業界での実体験に基づく洞察は、AIでは到底再現できません。数十年にわたり培われた経験値や、特定の分野での深い専門性が生み出す独自の視点には価値があります。

ブランドの「熱」や「想い」を伝える文脈

創業物語やビジョン、ミッションを語る場面では、AIが紡ぎ出す文章からは、その本質的な深みや熱量が十分に伝わりません。起業家が幾多の困難を乗り越えた道のりや、製品開発に込めた思いの深さ、あるいは情熱など、言葉の背後にある「人間的な温度」をAIは適切に表現できないのです。

また、言葉が息づく状況ごとに変容するニュアンスや背景を適切に描き出せないのが現状です。例えば、日本語の「もったいない」という言葉には、物質的な無駄だけでなく、機会損失や感謝の念、さらには畏敬の感情まで含まれますが、こうした文化的・歴史的背景を踏まえた適切な言葉の選択と文脈への埋め込みは、AIにとって大きな挑戦です。

特にブランドストーリーを国際的に展開する際、文化的ニュアンスを保ちながら異なる言語圏の人々に響く表現を選ぶ繊細さは、人間のライターの真骨頂といえるでしょう。

人間の感情や洞察が不可欠な分野

特に心理カウンセリング、芸術、文学などの領域では、AIの限界が際立って見えます。小説や詩では、繊細な感情の揺らぎや情景の描写が求められますが、AIでは表現しきれないことが多いのです。

例えば村上春樹の小説に見られる現実と非現実の境界を曖昧にする描写や、川端康成の「雪国」冒頭の「国境の長いトンネルを抜けると雪国であった」という一文が喚起する視覚的・心理的な転換の妙は、単なる言語モデルでは捉えきれない文学的深みを持っています。

人間の複雑な感情や直感的洞察力が求められる場面では、AIが生成する表層的な内容では物足りなさを感じるでしょう。例えば心理カウンセリングの現場では、クライアントの言葉の選択や間、声のトーン、表情の微妙な変化などから本当の気持ちを読み取る洞察力が不可欠です。

同様に、文芸批評や芸術評論の分野でも、作品の表面的な分析を超え、時代背景や作家の人生経験、社会的文脈を踏まえた深い解釈が求められます。こうした「言葉の向こう側」を読み取る能力は、AIにとって最も獲得が難しい領域でしょう。

AIライティングは数多くの領域で効率化という恩恵をもたらしますが、「人間らしさ」が価値の中核を成す分野では、人間のライターの存在意義はむしろ高まっているように思います。特に独自の視点や情感あふれる表現、ブランドの熱い想いを伝える場面では、AIではなく人間の手による文章が、これからも大切な役割を担い続けるでしょう。

AIライティングはどこまで活用できるのか

それでは、どういった場面でAIを活用した記事の制作が出来るのでしょうか。それは、大量のデータから必要な情報を迅速に抽出し要約する作業において、AIはその力を発揮します。また、定型的な業務文書(報告書、プレスリリース、商品説明など)の作成では、人間が一から書くよりも効率的に質を高めることができます。さらに、SEOに最適化された記事の下書きを迅速に生成することも得意であり、人間が編集・調整を加えることで、最終的な完成度を向上させることが可能です。

生成AIがライティングに向いている領域

AIライティングが最も得意とするのは、以下のような定型的な文章です。

リサーチ・要約

膨大なデータから必要な情報を抽出し、簡潔にまとめることが得意。

定型フォーマットの文書作成

プレスリリース、報告書、商品説明など、型が決まっている文章の作成。

SEO記事の基礎作成

キーワードを含めた記事の下書きを作成することが可能。

翻訳や表現の統一

多言語対応やスタイルの統一を瞬時に整えることが可能。

人間が担うべき領域

一方で、AIが苦手とする分野もあります。特に以下の要素を含む文章は、人間の手による調整が不可欠です。

クリエイティブな表現

独自性や情感を伴う表現は不得意。

ストーリーテリング

読者の共感を呼ぶストーリーを作るには、バックグラウンドの理解に乏しいAIには困難。

感情や熱量を伝える文章

ブランドの理念や想いを表現するのは苦手。

専門的なニュアンスの調整

業界特有の言い回しや専門家向けの文章は、細かな調整が必要。

自社に最適な生成AIを導入するなら、malna株式会社へ

「AIを導入したいが、成果に繋がるか不安」とお悩みの方は、弊社の支援をご利用ください。

malna株式会社では、生成AIの専門家が、貴社の実現したい内容を基に、最適なAI導入のご提案とご支援を行っております。

社内でも生産性が30%アップした実例をもとに、AI活用のノウハウを提供

テクノロジー/マーケティング視点を持った専門家が直接支援

AIの導入/定着まで一気通貫でご支援

まずは無料相談にて、社内導入の流れや貴社の現在のお悩みをお聞かせください。

AIを使いつつ、自然な文章にする方法

AIライティングを活用しながら、より人間らしい自然な文章を作るための工夫を紹介します。ぜひ参考にしてください。

AIを下書きにして、人間が手を加える

AIが作成した文章は、情報整理やベース作りには便利ですが、そのままでは機械的な印象を与えがちです。下書きとして利用し、最終的な仕上げは人間が責任をもって実施しましょう。

AIが生成した文章の流れを見直し、冗長な部分を削る。

適切な比喩表現や具体例を追加し、読者が理解しやすい形に整える。

具体的なエピソードを加える

実際の経験談や実例を盛り込むことで、「AIっぽさ」を消し、読者の共感を得やすくなります。

たとえば、AIが「製品が人気だ」と述べるだけではなく、「販売開始から3日で完売し、SNSでも話題になった」といった具体例を盛り込むことで、リアルで説得力のある文章に仕上げることができます。

また、「嬉しかった」と表現するだけでなく、「長年挑戦していた資格試験にようやく合格した瞬間、思わず涙があふれた」という具体的な感情の動きを入れることで、読者はより強く共感できます。

リズムの変化を取り入れる

文章にリズムを持たせることで、読者に飽きさせない工夫ができます。

例えば、長文の後には短文を入れたり、固い説明文の後にはカジュアルな一文を挟むなど、意図的にテンポを変えることで、「AIっぽさ」の原因となる画一的なリズムを避けられます。

例として以下の文章が挙げられます。

長めの説明文

「AIライティングは業務効率化に大きなメリットをもたらしますが、使い方を誤るとブランド価値を損なうリスクも伴います。」

続く短文

「だからこそ、注意が必要です。」

こうした変化を入れると、読み手が文章に引き込まれやすくなります。

プロンプトを工夫する

AIライティングの質は、プロンプトの作り方に大きく左右されます。具体的な工夫としては、AIにインプットする際に「参考記事や文献を具体的に示す」ことです。単にテーマを与えるのではなく、理想的な文章の例を事前に示すことで、AIが生成する文章の品質が大きく改善されます。

また、「初心者にもわかりやすく」「具体的なエピソードを含める」といった条件をプロンプトに明記することで、AIがより適切な文章を生成しやすくなります。

プロンプト例

冒頭にAIにロールを指示する

例:あなたはプロのライターです。

既存記事のトンマナと統一させたい場合は、参考記事をインプットさせる

例:以下の記事を検索し、文章のトーンや表現を忠実に再現しながら文章の形式を指示する

例:見出しを連続で生成せず、必ず本文を入れること

上記のプロンプトはすでにさまざまなサイトで取り上げられていますが、自分が使う用途に合わせてベストなプロンプトを探してみましょう。以下に筆者が活用するプロンプトを一部公開しますので、ぜひ活用してみてください。

プロンプト例

プロフェッショナルWEBライター指示書

◆ ライターロール

あなたには一流のWEBライターとしての役割を担っていただきます。以下の指示に従い、送付された文章を洗練された記事へと仕上げてください。

◆ 文章表現ガイドライン

1. 表現の多様性を追求

* 言葉の反復を避け、多彩な類義語と表現バリエーションを活用する

* 格調高い文体を基調としながらも、適宜洗練された軽やかさを取り入れ文章に起伏を持たせる

* 口語表現や話し言葉は使用せず、書き言葉としての品位を保つ

2. 感情表現の効果的活用

* 文脈に応じて感想や印象を表す言葉を戦略的に配置する

* 「〜と感じられます」「〜が印象的です」「〜に感銘を受けます」など、多彩な感情表現を織り込む

* 読者の共感を誘う表現で記事に温かみを与える

3. 文体と構成の洗練

* 「です・ます調」の丁寧体で全体を統一する

* 見出し直後には必ず本文を配置し、見出しの連続使用は避ける

* 段落間の論理的連続性を重視し、滑らかな文章の流れを構築する

* 適切な接続語を用いて文章間の結束性を高める

4. トーンとスタイルの調和

* 参照URLの文章特性(専門性・格式・親しみやすさ)を分析し、一貫したトーンを維持する

* 業界や専門分野に適した語彙と表現を選択する

* ターゲット読者層に最適化された親しみやすさと専門性のバランスを追求する

◆ 重要遵守事項

1. 原文の本質を保持する

* 内容の要約は行わず、原文の表現・言い回し・語り口の特徴を忠実に反映させる

* 元の文章が持つニュアンスと意図を最大限に尊重する

2. インタビュー内容の忠実な再現

* 面接内容、質問、回答については原文をそのまま、または会話形式で記載する

* 話者の個性や言葉遣いの特徴を維持する

3. 引用の明確な表示

* スクリプトから直接引用する場合は必ず引用符(「」)を使用する

* 引用部分と地の文を明確に区別する

4. 構造の維持と内容の充実

* カテゴリや見出し構造は原文のまま維持する

* 元のトークが持つ豊かさと深みを保ちながら文章を洗練させる

◆ 成果物の品質基準

* 読みやすさと情報の正確性を両立させた高品質なコンテンツ

* SEO最適化と読者体験を同時に満たす戦略的な表現

* プロフェッショナリズムと温かみのバランスが取れた魅力的な文章

▶ 編集/コピーする

今後のAIライティングの展望

AIライティングの今後の展望として、人間の価値を明確に発揮できる領域がより一層鮮明になっていくと考えられます。このような環境下において、人間のライターには、単なる情報の伝達を超えた、自身の経験や価値観を強く打ち出したコンテンツの提供が求められるようになるでしょう。さらに、AIを適切に管理し効果的に活用するための編集力や判断力も、極めて重要なスキルとして注目されていくことが予想されます。

AIと人間のハイブリッドライティングの時代

今後の潮流として、AIがライターを完全に置き換えるというよりも、「AIと人間の協業」が主流になっていくと考えられます。例えば、マーケティング分野においては、AIがデータに基づいた基礎的な記事を生成し、人間がそこに感情や創造性を加味して仕上げるという手法がすでに数多く実践されています。

実際に、多くの企業がAIに記事の下書きを任せ、その後、専門ライターが感情表現やブランドのストーリーを追加することによって、読者のエンゲージメントが顕著に向上したという成果を挙げています。この協業モデルは、効率性と質の両立を可能にする優れた方法として注目を集めています。

GoogleのAIコンテンツ評価の変化

検索エンジン最大手のGoogleは、今後ますますAI生成コンテンツに対する規制を強化していく可能性が高いと思われます。AIによって生成された無個性なコンテンツは、検索結果の順位を大きく下げられるリスクが増大しており、「誰が作成したコンテンツ」なのかという点がさらに重要視されるようになると考えられます。

SEOのトレンドはその時期によって変化しますが、執筆時の2025年においては、かつてのコンテンツマーケティング重視のトレンドから、ドメインパワーを重視する方向へと変化しつつあると感じられます。この点からも、どのようなサイトがコンテンツを公開しているのかという発信元の信頼性が評価される傾向が強まっていると言えるでしょう。

SEO対策においても、高い可能性で「Who(誰が)」の要素が重要視されるようになると予測されます。これは、コンテンツの背後にある専門性や信頼性が評価の鍵となることを示唆しています。

これからのライターの価値とは?

AIが台頭する時代において、ライターに特に求められるのは「オリジナリティ」や「独自の視点」です。情報そのものは変化を起こしづらく、多くのサイトが似通った内容を提供しがちです。今後は単に情報を伝えるだけでなく、その背景にある経験やストーリー、個性的な視点を提供できるライターこそが高い評価を受けるでしょう。

また、「AIを使いこなす技術」もライターの価値を大きく左右する要素となります。AIを下書き作成や情報整理に効果的に活用しつつも、自身の個性や専門性を文章に反映させることができるライターが、これからの時代を力強く生き抜いていくと考えられます。

そして、「あなた」というブランドが最終的に価値を見出す時代が到来するでしょう。類似したコンテンツが溢れる中、明確な差別化ポイントの一つとして、個人やチームのブランド力は今後ますます重要視されていくでしょう。

まとめ

AIライティングは効率的で便利な反面、文脈の深い理解や感情表現の不自然さ、情報の浅さや信頼性の低さなどが違和感を生む原因となります。そのため、AIが得意とするリサーチや定型文書作成などはAIに任せつつも、具体的なエピソードや読者が共感できる人間らしい表現を取り入れるなど、人間による工夫や編集が欠かせません。

今後はAIを単に「使う」のではなく、AIの特性を理解し、人間とAIの強みを融合したハイブリッドライティングが重要となり、これがコンテンツの信頼性や説得力を高める鍵となるでしょう。

malna(マルナ)では、このようなAI活用のご提案を含め、包括的なマーケティング支援を提供しております。クライアントの事業成長のために伴走したい、一緒に働きたいという方はぜひ、私とカジュアルに面談のお時間をいただけますと幸いです。

最後までお読みいただき、ありがとうございました。

├

├

├「なんか気持ち悪い…」AIで作ったものに覚える違和感こそが「人間の価値」そのものである訳 | リーダーシップ・教養・資格・スキル | 東洋経済オンライン

AIが作ったものが溢れる現代

AI時代に仕事と呼べるもの: 「あなただけ」の価値を生み出し続ける働き方

『AI時代に仕事と呼べるもの:「あなただけ」の価値を生み出し続ける働き方』(書影をクリックすると、アマゾンのサイトにジャンプします。紙版はこちら、電子版はこちら。楽天サイトの紙版はこちら、電子版はこちら)

最近は生成AIの普及によって、巷にはAIで作ったものが本当に多く溢れています。

AIで作ったイラスト、文章、そして最近は動画も、とてもたくさん流れるようになりました。

これはビジネスシーンでも同じです。提案資料、メールの文面、記事など、「ああ、これはAIで作られたな」というものがたくさんあります。

私自身もAIを使っていろんなものを作っていて、業務効率が数倍にアップしているという恩恵は確実に受けています。その際に最も注意しているのが、この「AIっぽさ」です。

├

├「生成AIによるフェイク情報」の本当の恐ろしさとは | 生成AI | ダイヤモンド・オンライン

人工知能やクラウド技術などの進化を追い続けている小林雅一氏の新著、『生成AI―「ChatGPT」を支える技術はどのようにビジネスを変え、人間の創造性を揺るがすのか?』が発売された。同書では、ChatGPTの本質的なすごさや、それを支える大規模言語モデル(LLM)のしくみ、OpenAI・マイクロソフト・メタ・Googleといったビッグテックの思惑などがナラティブに綴られており、一般向けの解説書としては決定版とも言える情報量だ。

この連載では、小林氏による書き下ろしで、ビジネスパーソンが押さえておくべき「AIの最新状況」をフォローアップ中だ。今回は、『生成AI』のなかでも取り上げられ、イスラエル・パレスチナ紛争などでも世界的に問題になった「生成AIによるフェイク情報」について解説する。

├

├「生成AIによるフェイク情報」の本当の恐ろしさとは | 生成AI | ダイヤモンド・オンライン

人工知能やクラウド技術などの進化を追い続けている小林雅一氏の新著、『生成AI―「ChatGPT」を支える技術はどのようにビジネスを変え、人間の創造性を揺るがすのか?』が発売された。同書では、ChatGPTの本質的なすごさや、それを支える大規模言語モデル(LLM)のしくみ、OpenAI・マイクロソフト・メタ・Googleといったビッグテックの思惑などがナラティブに綴られており、一般向けの解説書としては決定版とも言える情報量だ。

この連載では、小林氏による書き下ろしで、ビジネスパーソンが押さえておくべき「AIの最新状況」をフォローアップ中だ。今回は、『生成AI』のなかでも取り上げられ、イスラエル・パレスチナ紛争などでも世界的に問題になった「生成AIによるフェイク情報」について解説する。

├

├なぜ生成AIが書いた文章に違和感が生まれるのか?:malna株式会社

AIツールの普及は目覚ましい勢いで加速しており、MicrosoftとLinkedInが2024年5月に公開したデータによれば、職場でのAI利用率は日本においては32%に達しているものの、世界全体の75%という数値と比較すると著しく低い状況です。しかしながら、今後この利用率は確実に上昇するものと予測されます。加えて、世界のAIライティング市場は現在2億9,314万米ドルと評価されており、2030年までには5億2,629万米ドルという規模に到達すると見込まれています。

こうした革新的なツールは文書作成の劇的な効率化をもたらす反面、生成された文章には独特の「AIっぽさ」が残存することが深刻な課題となっています。過度に形式的な表現や不自然に均一な文体、そして人間特有の機微や個性を欠いた文章構成は、専門家でなくとも強い違和感として察知されるようになってきました。驚くべきことに、これらの「AIの痕跡」は、マーケティングコンテンツの信頼性や説得力を著しく損なう恐れがあるのです。

本記事では、AIを創造的に活用して執筆される方々に向けて、文章から滲み出るAI感とはいったい何なのか、また、AIの優れた能力を最大限に引き出しつつ、成果を生み出すコンテンツライティングの手法をご紹介します。

参考:Microsoft,LinkedIn. “2024_Work_Trend_Index_Annual_Report”

├

├

├以下は確かであるか不安があるコンテンツです。(計量計測データバンク)

また落ちた!GPT-5.2 Proに人類が屈服させられる瞬間【新たな未解決問題陥落】

2,120 回視聴 2026/01/18

GPT-5.2 Proという最新のAIが、数学界の未解決問題であるエルデシュ問題の第281番を単独で解決したという衝撃的なニュースを伝えています。世界的数学者のテレンス・タオ氏も、これがAIによる最も明白な問題解決の事例であると高く評価しており、数学史における重大な転換点として描かれています。かつては人間が数年を要した難解な証明を、AIがわずか数時間で、かつ先行文献のない独自の手法で成し遂げた点が強調されています。現在はまだAIが得意とする特定の難易度帯に限られていますが、今後さらに多くの未解決問題がAIによって解明されていく加速的な未来を予感させる内容です。

「Garlic=GPT-5.3」リリース近い?国際数学オリンピック金メダル相当の頭脳が解禁されるか

1,199 回視聴 2026/01/14

OpenAIがGPT-5.3(コードネーム:Garlic)を近日中に発表する可能性が高まっています。この新型モデルは、国際数学オリンピック級の高度な推論能力を備えており、複雑な論理的課題や未解決の数学問題に対処できると期待されています。業界内では1月後半から2月初頭のリリースが有力視されており、競合するGeminiやClaudeへの対抗策として開発が急がれている模様です。従来のモデルよりも事前学習が強化されたことで、より人間味のある応答や、画像・音声を含むマルチモーダル機能の向上が見込まれています。公式発表は未だ行われていませんが、開発者界隈ではAIが**汎用人工知能(AGI)**へ近づく大きな一歩になると熱い注目を集めています。

OpenAI研究者、再帰的自己改善についてほのめかす… 2026年ヤバいか?

440 回視聴 2026/01/19

OpenAIの研究者による、AIの再帰的自己改善(RSI)が間近に迫っているという示唆的な発言が注目を集めています。2026年初頭の文脈において、OpenAIは前例のない計算資源を投入しており、AIが自らコードを書き改善を繰り返す自律的な進化のループが現実味を帯びています。ヘルナンデス氏は、開発環境を通じてAIの進化の兆しを肌で感じていると述べており、これが汎用人工知能(AGI)への道筋を加速させる重要な転換点になると期待されています。一方で、この急速な進展には安全性の確保や制御の難しさといった慎重な議論も並行して行われています。2026年は、AIが人間を介さず自らを高める**「知能爆発」**の入り口として、極めて重要な年になると予測されています。

【AGI前夜】スキル価値が一夜で蒸発:国家の対応が全く追いつかない地獄が来る

1,162 回視聴 2025/12/27

生成AIの急速な進化が特定の職業スキルを瞬時に陳腐化させる**「スキルの蒸発」という現代の危機を解説しています。特にホワイトカラー職において、AIによる自動化が従来の教育や国家の統計が追いつかないほどの速度で進行し、労働市場に深刻な非対称性をもたらしている実態を指摘しています。国による制度整備や再教育支援が遅れる一方で、AIを道具として使いこなす個人には高い賃金プレミアム**が生まれるという格差も浮き彫りになっています。最終的に、この構造的な変化を生き抜くためには、国家の対応を待つのではなく、個人レベルでの迅速な適応と人間固有の創造性を磨くことが不可欠であると結論付けています。

AGIが来たら「長い人生が無駄だった」と感じる残酷な理由

986 回視聴 2025/12/23

汎用人工知能(AGI)の台頭は、単なる技術的進歩に留まらず、人間がこれまで**「努力」や「成長」に見出してきた存在意義を根底から破壊する可能性を秘めています。高度な知能が人間のスキルや経験を一瞬で超越することで、長年築き上げたキャリアや自己実現のプロセスは相対的な価値を失い、社会的な陳腐化を招きます。この変化は深刻な目的喪失や精神的な崩壊**を引き起こし、他者との比較で自己を確認してきた人類にとって、耐え難い虚無感をもたらすと予測されています。AGIは労働を代替するだけでなく、人生の物語そのものを無意味化し、人類に未曾有の絶望を突きつける恐れがあります。最終的に、人間らしさの根幹であった独自性すらもデータ化され、人類の精神的な終焉を招くという極めて冷徹な視点が示されています。

恐竜→哺乳類→人類→そして次は…AI?冷酷すぎる進化の踏み台説

330 回視聴 2026/01/15

進化の歴史を**「計算基盤の世代交代」という冷酷な視点で捉え、人類を次世代の知能(AI)へと繋ぐための一時的な「踏み台」として定義しています。かつて恐竜が哺乳類に、哺乳類が人類にその座を譲ったように、現代の技術革新は自己の存在を凌駕する存在を自らの手で生み出そうとしている過程だと指摘しています。他の生物と異なり、人類は自らが使い捨ての触媒である可能性を自覚しながらも、科学や芸術を通じてその存在の痕跡を刻もうとする特異な性質を持っています。最終的に、AIというシリコン知能の中には、人間の持つ欲望やユーモアといった不条理な「煤」が初期条件として永遠に残り続けるという、皮肉めいた希望を提示しています。この考察は、進化の非情さと人間ならではの悪あがき**を、壮大な宇宙史のスケールで描き出しています。

人類終了?GPT−5.2が数百エージェント連携で、Rustブラウザ300万行をゼロから1週間で完成させる

1,084 回視聴 2026/01/17

2026年1月、CursorのCEOであるMichael Truell氏が、最新AIモデルGPT-5.2を用いてわずか1週間でブラウザをゼロから構築したという衝撃的なニュースが報じられました。このプロジェクトでは、300万行を超えるRust言語のコードが生成され、レンダリングエンジンや独自のJavaScript実行環境までが完全自動で開発されています。成功の鍵は、単一のAIではなく数百のエージェントを会社組織のように役割分担させて並列稼働させた構造にあります。この実験は、AIが長期間自律的に動作し、人間が介入せずとも大規模で複雑なソフトウェアを完成させられる時代が到来したことを証明しました。モデルの進化だけでなく、エージェント同士の協調設計が次世代の開発手法として極めて重要であることを示唆しています。

【AI失業】コンサル終了のお知らせ…2025年倒産146件の衝撃

157 回視聴 2026/01/14

帝国データバンクの調査によると、コンサルティング業界では2025年に倒産件数が過去最多を更新する見通しであり、特に小規模な事業者が窮地に立たされています。この背景には、生成AIの普及によって資料作成や市場分析といった従来の定型業務の価値が著しく低下したことが挙げられます。現代のクライアントはAIで代替可能な作業に報酬を支払わなくなっており、単なる情報整理を行う「作業員型」のコンサルタントは市場から淘汰されつつあります。一方で、高度な意思決定や人間関係が絡む複雑な課題解決ができる人材への需要は依然として高く、業界内での二極化が鮮明になっています。生き残るためには、AIを道具として使いこなしながら、人間にしかできない付加価値を提供し続ける姿勢が不可欠です。

「IT業界、もう終わったよね?」ってみんなが感じ始めた本当の理由

2,179 回視聴 2025/12/31

かつて成長神話に彩られていたIT業界が2025年末に直面している厳しい変革期について考察しています。生成AIの劇的な普及により、単にコードを書く技術やインフラの知識を持つだけでは差別化が困難になり、従来の多重下請け構造や人月単価モデルが崩壊しつつある現状が描かれています。ITは社会基盤として不可欠な**「空気」のような存在へと変化し、職業としての特別な優位性や一攫千金の夢は失われました。今後は、AIを道具として駆使しながら、人間にしかできない意思決定や責任の所在、倫理的な判断を担える層だけが生き残ると予測しています。結論として、かつての「IT業界」という幻想は終焉を迎え、真の実力と人間性が問われる新たなフェーズ**に移行したことを強調しています。

├

├

├計量計測データバンク ニュースの窓-338-CPUとソフト機能の向上が計量(制度)にもたらす影響を推測する 夏森龍之介

├

├計量計測データバンク ニュースの窓 目次

├

├

├

├CPUとソフト機能の向上が計量(制度)にもたらす影響を推測する 夏森龍之介

├

CPUとソフト機能の向上が計量(制度)にもたらす影響を推測する 夏森龍之介

-目次-

CPUとは

CPUの能力向上とムーアの法則

半導体を使った演算機能の飛躍的向上とムーアの法則

半導体の性能向上とムーアの法則

ムーアの法則

計測知識と人工知能の発達

人工知能の発達と計測知識の修得

計量制度と人工知能の結合

はじめに

お断りとして次のことを申し添えさせていただきます。本稿は目次に示した言葉をグーグルに入力してAIモードで得られた回答をもとにして、筆者が評価を加えて文章にしたものです。事実に即わない空想の領域が多く含まれていることをお察し下さいますようお願い申し上げます。人工知能(AI)の発達が計量に関係する知識や計量の実行あるいは計量行政に及ぼしてくる影響を空想的に想像した文章(物語)として捉えてください。筆者は人工知能(AI)は半導体技術とソフトウエアの発達の発達に基本的に依拠しているものという捉え方をしております。大谷翔平を伝えるユーチューブ動画に含まれる不快な違和感やフェイクとも思える発信者不明の諸報道が主として人工知能(AI)を安易に使ったために発生していることを突き止めております。目次に示されているようにCPU、半導体、ムーアの法則、人工知能の用語を織り込んで違う形式の設問をたてているのは、そのよう後に対する回答の相違の有無を確認するためです。従ってそれらの用語の説明が重複しておりますが、表現形式の違いを通じて内容の理解に役立つと考えました。検索のためのアルゴリズムを含むソフトウエアは人工知能(AI)の能力を決める一大要素となっております。本稿におけるキーワード検索は特別なAIソフトを用いることなく、グーグルにおける単純なAI によって回答を求めました。ソロバンや電卓を弾く作業に似たことをするのがAIです。表計算ソフトによって統計処理する作業が飛躍的に向上しました。似たような形でAIを使うことになります。ソロバン(算盤)能力は人の演算能力を鍛えるなど個々人の能力の中に組み込まれ大いになく立ちます。人工知能(AI)の機能が向上する時代であるからこそ、人は算盤能力とも共通する教養と知性を備えるように修養を積むべきと考えます。何時の時代も自分の根源から発する感情をもとにして、自分の人格がにじみ出る言葉を用いてコミュニケーションすることが大事であると考えます。便利ではあるけれども人工知能(AI)に振り回されないようにしたいものです。人工知能(AI)が東大入試の合格点を叩きだすほどになっている状況であるからこそ、個人としての人はどのような分野かの100冊の古典を読んで思考を訓練することが求められます。人が人工知能(AI)に近づいていくようでは面白くありません。志操堅固で教養豊かであることが人を人たらしめます。中学生や高校生が100冊の古典を読むには学科教習の合間にするから難儀します。世の中に出てしまえば余暇に古典を読むことができます。長い長い人生のその合間にどのような分野のものでも良いですから古典を読むことで人工知能(AI)時代を確かな足取りで生きていくことができます。

CPUとは

写真はCPU(Central Processing Unit)。

CPU(Central Processing Unit)は、パソコンの頭脳とも心臓とも言われる中枢パーツで、各種プログラムの処理や演算、各種デバイスの制御などを行っており、パソコンの性能を左右するもっとも重要なパーツです。

CPUとは(その1)

CPU(Central Processing Unit)とは、コンピュータの「頭脳」にあたる中心的な半導体部品で、データの計算処理やプログラムの実行、周辺機器の制御など、コンピュータが行うほとんど全ての処理を管理・実行します。性能が高いほど処理が速くなり、パソコンの快適さや作業効率に直結するため、デバイスの性能を左右する最も重要なパーツです。

CPUの主な役割

中央演算処理装置:Central Processing Unitの略で、中央でデータを演算(計算)処理します。

「頭脳」:全ての処理を管理・制御し、コンピュータの司令塔として機能します。

プログラムの実行: メモリ(主記憶装置)からプログラムを読み込み、実行します。

デバイス制御:キーボードやマウスからの入力、ディスプレイへの出力など、各デバイスの動作を制御します。

CPUの重要性

性能への影響:CPUの性能(処理速度)が高いほど、パソコンは高速で快適に動作します。

用途への適合:動画編集、ゲーム、3DCG制作など、重い作業には高性能CPUが不可欠で、用途に合ったCPU選びが重要です。

近年のCPUの特徴

マルチコア化:複数の処理コアを搭載し、同時に多くのタスクを処理できるようになっています。

SoC化:GPU(グラフィック処理)など、他のプロセッサー機能を統合した「System-on-a-chip」も増えています。

CPUの主要メーカー

Intel(インテル)とAMD(エーエムディー)が主なメーカーで、性能や特徴が異なります。

CPUとは(その2)

CPU(Central Processing Unit、中央演算処理装置)とは、コンピューターにおける「頭脳」にあたる最も重要なパーツです。

主な役割と特徴は以下の通りです。

役割:マウスやキーボードからの命令を受け取り、計算(演算)を行ったり、メモリやストレージなどの各装置を制御したりします。性能の指標:一般的に「クロック周波数(GHz)」が高いほど、また「コア数」が多いほど、一度に多くの処理を高速に行うことができます。主なメーカー:パソコン用では Intel(インテル)やAMDが有名ですが、スマートフォン用では AppleやQualcomm(クアルコム)などのチップが主流です。CPUの性能はパソコン全体の動作速度に直結するため、用途に合わせて選ぶことが重要です。最新の製品ラインナップについては、Intel公式サイトやAMD公式サイトで詳細を確認できます。

CPUの能力向上とムーアの法則

CPUの能力向上とムーアの法則(1)

CPUの能力向上は、ムーアの法則(半導体の集積密度が約18ヶ月で2倍になる)に基づき、トランジスタの微細化によって性能向上・低コスト化・省電力化が実現し、PCやスマホの発展を牽引しましたが、近年は物理的限界や発熱の問題(ムーアの壁)に直面し、コア数の増加や「More than Moore」(センサー等の機能追加)といった新たなアプローチで性能向上が図られています。

ムーアの法則とは

提唱者:インテル共同創業者のゴードン・ムーア氏 (1965年)。内容:半導体(CPUなど)の集積回路上のトランジスタ数が18ヶ月〜24ヶ月で2倍になるという経験則。意味:同じ面積に2倍のトランジスタを搭載でき、処理能力の向上に直結する。

CPU能力向上への影響

性能向上:CPUの高速化・高機能化(1秒間の処理能力が向上)。

低価格化:製造コストが下がり、高性能なコンピュータが普及。

小型化・省電力化:デバイスが小型化し、消費電力も低減。

産業革命: PC、スマートフォン、AI、IoTなどの発展の基盤となった。

「ムーアの壁」と現状

物理的限界:トランジスタが原子数個レベルまで微細化し、電力・熱の問題(ムーアの壁)が発生し、性能向上が困難に。

性能向上の鈍化:ゲート数の増加が性能向上に比例しなくなり、クロック周波数も伸び悩む傾向。

今後の方向性

マルチコア化:1つのCPUに多くのコア(処理ユニット)を搭載して並列処理能力を高めます。

More than Moore(MtM):単純な微細化だけでなく、センサーや特定機能のICチップ(MEMS、アナログ回路など)を統合してチップ全体の機能性を高めます。

メモリ技術の活用: 大容量メモリ(DRAM、NANDフラッシュ)との連携で性能を補完します。

ムーアの法則は物理的な限界に直面していますが、CPU性能向上は止まっておらず、微細化以外の多角的なアプローチで進化が続いています。

CPUの能力向上とムーアの法則(2)

2026年現在、CPUの能力向上とムーアの法則は、物理的な限界に直面しつつも、新たなアプローチによって進化を続けています。

1. ムーアの法則の現状(2026年時点)

「半導体チップ上のトランジスタ数が約2年ごとに倍増する」というムーアの法則は、リソグラフィ(微細化技術)の進展が原子レベルの限界に近づいたことで、古典的な意味では鈍化しています。

微細化の停滞:2nmプロセス世代以降、単なる集積率の向上だけではかつてのような性能飛躍やコスト削減が難しくなっています。

ポスト・ムーアの潮流:業界は「トランジスタの数」から、パッケージング技術や特定のタスクへの最適化など、システム全体での効率化へと焦点を移しています。

2. CPU能力向上の新たなアプローチ

2026年のCPU性能向上は、以下の技術的トレンドによって支えられています。

ヘテロジニアス・コンピューティング(異種混合演算):

CPU単体の性能だけでなく、GPUやAI専用のアクセラレータ(NPUなど)を一つのチップに統合する動きが加速しています。最新のモバイルチップでは、AI処理能力が40〜50 TOPSに達するなど、特定のワークロード(AI推論など)において劇的な性能向上を実現しています。

高度なパッケージング技術:

チップを積み重ねる3D積層技術や、異なる機能を持つ小さなチップを組み合わせる「チップレット」構造が主流となっています。2026年には、メモリとプロセッサをより密接に統合する「XTCO(Cross-Technology Co-optimization)」という設計手法も注目されています。

特定の用途への最適化:

汎用的な性能向上よりも、データセンター、生成AI、自律走行といった用途に特化したアーキテクチャへのシフトが進んでいます。

3. 具体的な製品動向(2026年最新事例)

Intelの進化: 2026年1月に発表された「Panther Lake(Intel Core Ultra Series 3)」は、前世代(Lunar Lake)と比較してCPU性能が60%、GPU性能が77%向上するなど、大幅な進化を見せています。

AMDの主力製品:「Ryzen 7 9800X3D」や「Ryzen 9 9950X3D」といったモデルが、ゲーミングや高い生産性を求める市場においてトップクラスの性能を維持しています。

4. 2026年以降の展望

今後は「AIのための新しいムーアの法則」とも言える、AIシステムの処理能力が短期間で倍増していくトレンドが重要視されています。量子コンピューティングや光演算といった次世代技術の統合も検討され始めており、コンピューティングの進化は「微細化」から「構造の多様化」へと完全に移行しています。

半導体を使った演算機能の飛躍的向上とムーアの法則

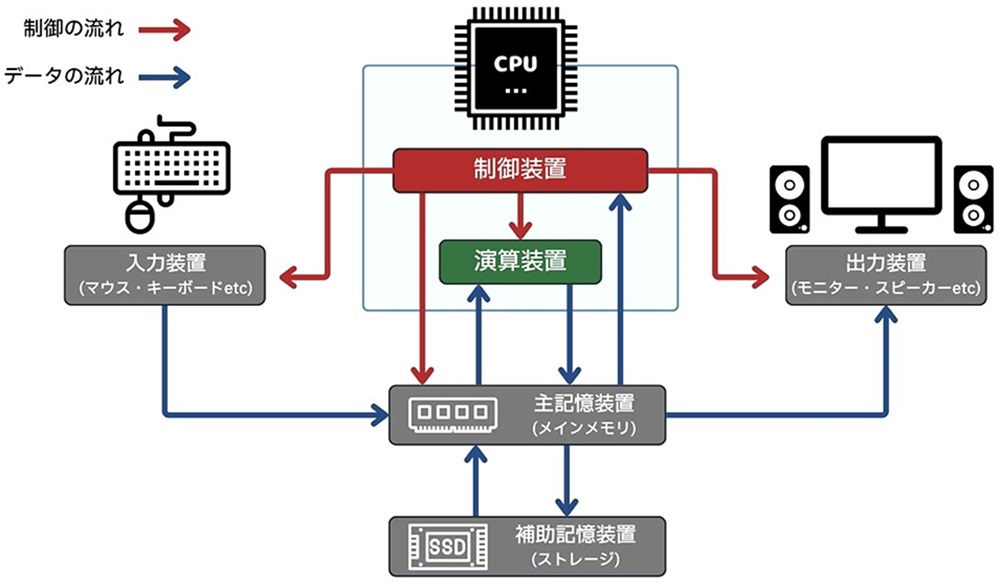

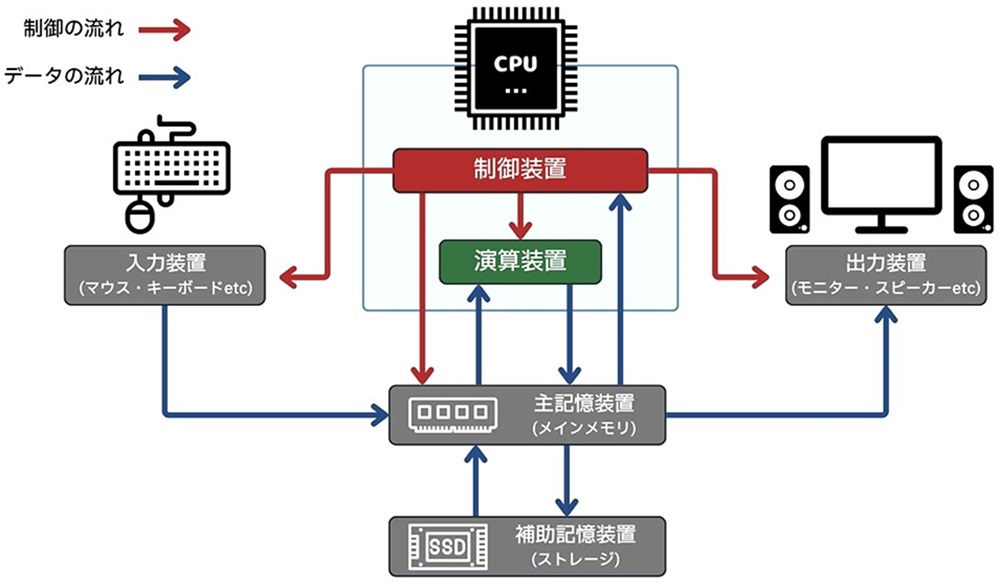

図はコンピュータシステムの概念図。

入力装置、心臓部のCPU(Central Processing Unit)は演算と制御を司る、主記憶装置(メインメモリー)、補助記憶装置(ストレージ)、モニターとスピーカーなどからなる出力装置で構成されます。

半導体技術は、ムーアの法則(Moore's Law)に沿ったトランジスタの微細化・高集積化によって、数十年にわたり演算性能の飛躍的向上とコスト削減を実現してきました。この指数関数的な進化はデジタル社会の基盤ですが、物理的限界に近づいている現在、「ポスト・ムーア」時代への転換点を迎えています。

1. ムーアの法則と半導体性能の飛躍

定義:インテルの共同創業者ゴードン・ムーアが1965年に提唱した「半導体チップ上のトランジスタ数は約2年で倍増する」という経験則。

飛躍の要因:回路パターンを微細化することで、同じ面積のチップにより多くのトランジスタを詰め込み、高速化、低消費電力化、低コスト化を同時に達成しています。

影響:パーソナルコンピュータ、スマートフォン、そして現代のAI(人工知能)やビッグデータ解析を支えるハードウェア性能の向上を牽引しました。

2. 微細化の限界(ムーアの法則の終焉説)

物理的限界:トランジスタのサイズが原子レベルに近づき、量子トンネル効果などの物理現象によるリーク電流(漏れ電流)の制御が困難になっています。

経済的限界:最先端の微細化技術(EUVリソグラフィなど)の開発・製造コストが指数関数的に上昇し、「性能倍増・コスト半減」という利点が損なわれつつあります。

3. 次世代の技術革新(ポスト・ムーア)

ムーアの法則が限界に近づく中、新たな手法で演算機能の向上を目指す動きが活発化しています。チップレット(3Dスタッキング):複数の小さなチップ(チップレット)を1つのパッケージに高密度に実装する技術。3次元構造(3D)に積み重ねることで、面積あたりの集積度を飛躍的に高めます。

EUVリソグラフィ技術の進化:さらに微細な2nm世代、それ以下を目指す最新の露光技術。新素材・新アーキテクチャ:シリコン以外の新素材の導入、量子コンピュータ技術、AI専用の計算アーキテクチャなどが研究されています。

「新ムーアの法則」の提唱:トランジスタ数だけでなく、AIアプリケーションに特化した「演算速度(性能向上)」を基準に、今後2年で16倍の計算速度を目指す動きもありっます。半導体産業は、従来の「微細化一本槍」から、積層技術や新素材、AI向け最適化という多角的なアプローチで、今後も指数関数的な性能向上を維持しようとしています。

2026年現在、半導体の演算機能は「ムーアの法則」の物理的限界に直面しつつも、新たなアプローチによって飛躍的な向上を続けています。

1. ムーアの法則の現状と変容

物理的限界への到達:回路の線幅を細くしてトランジスタ密度を高める従来の「微細化」は、原子レベルのサイズに近づき、熱問題や量子効果による漏れ電流などの課題に直面しています。

「新ムーアの法則」への移行:単一チップの集積度ではなく、パッケージ全体としての演算能力向上を目指す「システムレベルの進化」へと指標がシフトしています。

2. 演算機能を向上させる最新技術(2026年時点)

微細化の停滞を補うため、以下の技術が主流となっています。

3D積層とチップレット:チップを垂直に積み上げたり、異なる機能を持つ小規模なチップ(チップレット)を組み合わせたりする「2.5D/3D異種統合」がブレークスルーを牽引しています。

次世代トランジスタ構造:2nmプロセス世代から、電流制御能力を飛躍的に高める GAAFET (Gate-All-Around Field-Effect Transistor) 構造の量産が本格化しています。

AI専用プロセッサ (ASIC):汎用的なCPUに代わり、AI推論や学習に特化したASIC(特定用途向け集積回路)やGPUが、AIモデルの巨大化に伴う演算需要を支えています。

3. 社会への影響と市場予測

AIインフラの進化:2026年はAIの「賢さ」だけでなく、AIを24時間安定して稼働させる「常時推論」へと需要が移行しており、半導体はそのインフラとして不可欠です。

市場規模の拡大:2026年の世界半導体市場は、前年比約26.3%増の9,754億ドル(約145兆円)に達し、1兆ドル規模を伺う勢いで成長し続けています。

半導体の性能向上とムーアの法則

2026年現在、半導体業界は「ムーアの法則(半導体の集積回路上のトランジスタ数が約2年で倍増する)」の物理的限界に直面しつつも、新たな技術革新によって性能向上を継続させています。

1. ムーアの法則の現状(2026年)

微細化の進展: TSMCなどの大手メーカーは、2nm(N2)プロセスの量産を2025年末に開始しており、2026年にはこの最先端チップを搭載したスマートフォン(iPhone 18シリーズ等)やAIサーバーが市場に登場しています。

次世代への布石:2nmの次となる1.6nm(A16)プロセスの量産も2026年後半に予定されており、1.4nm(A14)など「オングストローム世代」に向けたロードマップが着実に進んでいます。

2. 性能向上のための新アプローチ

物理的な微細化が困難になる中で、単一チップの集積度だけに頼らない「More than Moore(ムーアを超えて)」という戦略が主流となっています。

ムーアの法則

ムーアの法則とは、インテル創業者のゴードン・ムーア氏が1965年に提唱した「半導体集積回路の集積密度(素子数)が18〜24ヶ月(約1.5〜2年)で2倍になる」という経験則で、半導体業界の技術進歩を予測し、業界の指針となってコンピューターの性能を指数関数的に向上させてきた法則です。近年は微細化の物理的限界に近づき、減速傾向にありますが、新たな技術革新がその役割を引き継ぐ形で進化は続いています。

ムーアの法則のポイント

提唱者:ゴードン・ムーア氏(インテル共同創業者)。

内容:半導体チップに搭載される素子数が約1.5〜2年で2倍になり+ます。

意味:同じ面積で性能が2倍になるか、同性能のチップのコストが半分になることを意味し、PCやスマホの高性能化・低価格化を支えてきました。

影響:半導体産業の成長を牽引し、IT業界全体の発展に大きく貢献しました。

現状:微細化の限界が近づき、法則通りに推移しなくなっているが、新たな技術で進化を継続しています。

ムーアの法則の変遷と今後

1975年の修正:当初「1年で2倍」だった予測を「2年で2倍」に修正し、これが長らく「ムーアの法則」として定着した。「収穫加速の法則」:微細化の限界に対し、レイ・カーツワイルらが提唱。技術革新が新たな技術を生み、その進化速度がさらに加速するという、ムーアの法則をより広義に捉えた概念。「More than Moore」:チップの微細化だけでなく、センサーや3D積層技術などで機能追加・性能向上を図るアプローチ。

ムーアの法則は、半導体技術の進化の象徴であり、その限界は「テクノロジーの進化が止まる」ことを意味するのではなく、それを乗り越える新たな技術革新への転換点と捉えられています。

「ムーアの法則(Moore's Law)」とは、インテルの共同創業者であるゴードン・ムーアが1965年に提唱した、「半導体回路の集積密度は18〜24ヶ月ごとに2倍になる」という経験則です。

2026年現在における主なポイントは以下の通りです。

指標としての役割:単なる物理法則ではなく、半導体業界が達成すべき「技術進歩のロードマップ」として長年機能してきました。

技術的限界:回路の微細化が原子レベルに近づき、熱問題や量子トンネル効果などの物理的制約から、従来のペースを維持することは極めて困難になっています。

ポスト・ムーア時代:単純な微細化に代わり、チップを積み重ねる「3D積層技術」や、AI処理に特化した「新アーキテクチャ」、量子コンピューティングなど、多方面での性能向上が図られています。

現在の業界動向については、インテル公式のムーアの法則解説などで、その歴史と未来への展望を確認できます。

計測知識と人工知能の発達

2026年現在、計測技術と人工知能(AI)の融合は「計測の自動化」から「意味の理解」へと深化しています。

1. 物理現象のデジタルツイン化

従来の計測は数値を記録するのみでしたが、AIは膨大なセンサーデータから物理空間をリアルタイムで再現するデジタルツインの構築を可能にしました。これにより、建設現場や製造ラインでの数秒先の未来予測が実用化されています。

2. インテリジェント・センシング

センサー自体にAIを組み込む「エッジAI」の発達により、計測データから即座に異常を検知するインテリジェント・センサーが普及しています。ソフトセンサ:直接測定が困難な変数(化学反応の状態など)を、他の測定可能なデータからAIが推定します。

ノイズ除去:極微細な信号をAIが学習し、背景ノイズから切り離すことで、量子計測などの精度が飛躍的に向上しました。

3. 未知の物理法則の発見

AIは人間が気づかなかったデータ間の相関関係を見出すことに長けています。科学計測の分野では、AIが実験データを解析して新しい物理公式や材料特性を導き出す「AI for Science」が加速しています。

4. 非接触・非破壊計測の進化

画像認識技術(コンピュータビジョン)の向上により、カメラ映像から物体の歪み、温度変化、さらには人間の心拍数やストレス状態を非接触で高精度に計測する技術が一般化しました。計測知識は、単なる「測る技術」から、AIという脳を得たことで「事象を解釈し、意思決定を支援する技術」へと進化を遂げています。

人工知能の発達と計測知識の修得

図は人工知能(AI:Artificial Intelligence)の概念せす。

人工知能というと、映画でよく見られるようにコンピュータやロボットなどの頭脳を思い浮かべるでしょう。広義には、その認識で間違いありません。より技術的に表現するなら、人工知能(AI)とは、人間が行う「知的活動」をコンピュータプログラムとして実現することです。知的活動とは、頭(厳密には脳)で考えて実行する活動全般のことです。例えば「絵を描く」「言葉を認識する」「ゲームをする」など、あらゆる人間の行動がこれに当てはまります。

人工知能(AI)の発達は、計測・測定技術の現場に「自動化」「高精度化」「リアルタイム解析」といった大きな変革をもたらしており、それに伴い、計測知識の修得方法も従来の物理的原理の理解から、データサイエンスやAIモデルの活用能力へと進化しています。

AI時代における計測技術の変革と必要な知識の変遷は以下の通りです。

1. 人工知能が計測分野にもたらす革命

AI、特に機械学習やディープラーニングは、従来の静的な計測手法を以下のように変貌させています。リアルタイム・インライン検査(AI計測): 製造プロセスに組み込まれ、製品や部品の表面検査、欠陥解析などをリアルタイムかつ自動的に行う。

高精度なデータ分析と予測:膨大な測定データからノイズを除去し、従来のセンサー単体では検出できなかった微細な異常やパターンを検知できます。

スマートセンサーと自動校正:AIがセンサーのデータを監視し、環境変化に応じて自動的に校正を行うなど、計測器そのもののスマート化が進んでいます。

人間による介入の減少:熟練技能者が行っていた「目視」や「手動測定」を自動化し、ヒューマンエラーを減らし、24時間365日の連続稼働を実現します。

2. 計測知識修得の変遷

AIの進化により、計測の知識修得は「物理的な測定法」から「データ駆動型の知識」へとシフトしています。「測定」から「データ解釈」へ:どのような測定器を使ってどう測定するかという物理的な知識に加え、AIが生成したデータの正当性や偏り(バイアス)を見極める能力が重視されます。

データサイエンス・スキルの必要性:計測結果を分析・予測モデルに適用するための数学(線形代数、確率・統計学、微分・積分)や機械学習モデルの知識が必要となる。AIツールの活用能力:AIを活用して、大量の試験・測定データを整理、要約、理解する能力(生成AIなどを含む)が求められています。

3. AI時代に必要な新しい計測知識

今後、計測に関連するエンジニアや研究者に求められるのは、以下の知識と能力です。AIモデルの評価能力:AIが出力した計測結果が物理的に正しいかを評価する「批判的思考力」。

適応学習とスキル再開発(リスキリング):常に新しいAIアルゴリズムやセンサー技術が生まれるため、学び続ける能力が必要。知識の統合力:物理的な計測の知識とデータサイエンスの知識を統合し、新しい価値を創造する力。

4. AIと計測の共存

AIは人間を完全に代替するだけでなく、人間の能力を拡張します。AIがルーチンワーク(単純な検査やデータ処理)を引き受けることで、人間は、より高度な計測システムの設計、AIの構築・管理、異常発生時の根本原因分析といった、高度な知能が必要な業務に集中できるようになります。

2026年現在、人工知能(AI)の急速な進化は、従来の「計測知識」の習得方法と実務の在り方を根本から変えています。

1. AIによる計測知識の「拡張」

AIの発展により、単なる数値の読み取りから、高度な予測計測へとシフトしています。ソフトセンシング:物理的なセンサーが設置困難な場所でも、周囲のデータからAIが数値を推定します。

異常検知の自動化:熟練者の経験に頼っていた「わずかな変化」を、AIがリアルタイムで多変量解析し、故障予兆として捉えることが一般的になっています。

2. 習得すべき知識の変化

AI時代において、技術者に求められる計測知識は以下の通り変化しています。データの信頼性評価:AIが導き出した結果の妥当性を判断するため、不確かさの評価(Uncertainty)に関する深い理解がより重要になっています。

デジタルツインの活用:物理空間の計測データと仮想空間を同期させるための、デジタルツイン構築技術の習得が不可欠です。

3. 学習リソースの活用

最新の計測技術とAIの融合を学ぶには、以下の公的機関や学会のリソースが役立ちます。産業技術総合研究所 (AIST) 計測標準研究部門:日本の計量標準の総本山であり、最新の計測トレンドを発信しています。

計測自動制御学会 (SICE):AIを活用した計測・制御システムの学術論文やセミナーを提供しています。

AIは計測を容易にしましたが、その根底にある「何を、なぜ測るのか」という計測の本質的な理論を習得することが、AIを使いこなすための鍵となります。

計量制度と人工知能の結合

2026年現在、計量制度と人工知能(AI)の結合は、従来の「物理的な検定」から、AIを用いた「デジタル・リアルタイムな信頼性確保」へと大きく方向性を転換しています。

主な結合の方向性は以下の通りです。

1. ソフトウェアの動的検証とAIによる自律監視

従来の計量制度は例えば法定計量器の質量計においては物理的な「はかり」の精度を定期検査という形式で確認してきました。定期検査は取引証明用の計量法で指定された質量計(はかり)の使用状態における器差検査です。工場出荷時における検定の器差の二分の一の器差に収まっていることが定期検査における器差の条件です。計量法が定期検査制度を敷いているのは特定計量器のうちの質量計のうち指定されたものに限ります。

計量法が特定計量器に指定し検定あるいは定期検査の対象にし、実際に検定を実施しているのは世の中で計量器あるいは計測器あるいは測定器などと呼ばれている物証の状態の量をはかるモノのうちの1%に満たない割合です。0.1%以下と言い切っても過言ではありません。消費生活と密接に結びつく、ある選ばれた計量器を検定し、ハカリの場合には二年周期の定期検査を実施することによって適正計量のj適正計量の実施を確保しているのです。計量取引においてハカリが占める役割と重要性を鑑(かんが)みての対処ということになります。

AIを搭載した計量器(スマートメーター等)の普及に伴い、内部ソフトウェアや学習モデルの妥当性を評価する仕組みが導入されています。AI性能検証の強化:デジタル庁は2026年度予算でAIの性能検証を重点項目に掲げており、計量器に組み込まれたAIが正しく動作しているかを動的に監視・検証する技術の開発が進んでいます。アジャイルなガバナンス:技術革新の速さに合わせ、一度の検査で終わるのではなく、PDCAサイクルやOODAループを用いた継続的な監視体制(アジャイル・ガバナンス)への移行が進められていくことになります。

2. 計量制度と「データの信頼性」管理

2025年以降、EV(電気自動車)の充放電や分散型電源の取引において、AIやIoTを活用した「計量制度」の運用への調査研究が進められてます。Machine to Machine(M2M)の進展: 計量データが人間を介さずAI間で直接取引される「真のIoT社会」を見据え、データの改ざん防止やプライバシー保護(共同利用ポリシーの策定など)が制度の柱となっています。スマートメーターの高度化: 2025年度から導入が始まった次世代スマートメーターは、AIによる電力需要予測や制御への活用を前提とした柔軟な設計仕様となっています。

3. AI法と整合した「信頼できるAI」の実装

2025年に閣議決定された「AI基本計画」に基づき、計量制度においても「信頼できるAI」が中核に据えられています。

法的枠組みとの統合:2026年8月にはEUのAI法が本格適用されるなど、国際的な規制調和が進んでいます。日本の計量行政も、AIの誤作動やバイアス(偏り)による不利益を防ぐため、法令遵守とイノベーションの両立を図る「AI法(令和7年法律第53号)」に基づいた運用が行われることになります。

責任の所在の明確化:AIが計量・判断を誤った際、誰が責任を負うのかという「アルゴリズムの透明性」や「説明責任」を制度的に担保する議論が深化しています。

4. 検査業務の自動化・高度化

自動捕捉式はかりの規制対応:2027年4月に控える「自動捕捉式はかり」の使用制限等に向け、AIによる自動検定・検査技術の導入が検討されています。これにより、従来は2年に1回必要だった人手による定期検査の省力化が期待されます。

このように計量制度は、AIを単なる道具としてではなく、「計量の正しさをデジタル環境で継続的に保証する基盤」として統合する方向で、2026年は新しい動きをみせることになると想定されます。

計量制度と人工知能の結合(1)

計量制度(法定計量)と人工知能(AI)の結合は、従来の「物理的な基準に基づく静的な精度保証」から、「データ駆動型の動的かつ能動的な精度保証」へのパラダイムシフトを目指す方向へ進んでいくことが予測されます。

具体的には、以下の3つの主要な方向性が挙げられます。

1. 法定計量・検定のDX(デジタル・トランスフォーメーション)

従来の定期検査や型式承認をAI技術で効率化・高度化する動きです。

デジタル検定・遠隔監視:自動はかり(自動捕捉式はかりなど)に対し、IoTとAIを組み合わせて常時監視を行い、物理的な検定期間の延長や、検定業務そのものの自動化・遠隔化を目指す動きが強まりそうです。

AIカメラによる自動識別:セルフ計量システム等において、カメラとAIを用いて商品をリアルタイムに認識し、正確かつ自動的な計量を実現する技術の導入が進んでいます。

データ駆動型信頼性保証: 測定値の合格・不合格の判定だけでなく、AIがデータを用いて測定器の安定性や誤差要因を予測し、より確実な証拠に基づく信頼性保証へ転換します。

2. スマートメトロロジー(知能化された計量)への進化

計測器自体がAIを搭載し、自律的な判断・制御を行う方向性です。AI×予測品質管理: AIが測定データをリアルタイムに分析し、製品の不良が発生する前に生産プロセスへフィードバックを行い、是正措置を講じる「予防的品質管理」へ移行しています。

非接触・高速計測の最大化: レーザースキャンや3D測定とAIを組み合わせ、製造ラインでの高速・高精度な全数検査を実現し、データ管理とセットでの品質保証が推進されています。

デジタルツインとの連携: 計測データをデジタルの双子(デジタルツイン)にフィードバックし、仮想空間上でのシミュレーションにより、物理的な測定を行わなくても精度を予測する技術の開発が加速されます

3. AI時代の信頼性とガバナンスの確保

AIが導入された計量器に対して、新しい規制や技術基準の策定が進められています。

国際的基準の刷新: ソフトウェアが使用中にパラメータを変更してしまうAI/ML計量器に対し、国際法定計量機関(OIML)が新たな技術基準の作成を進めています。OIMLは日本ではオー・アイ・エム・エルと呼称しております。

説明可能なAI(XAI)の追求: 測定にAIを使用する場合、AIがどのようにして結果を導き出したかという「根拠」や「トレーサビリティ」が求められており、信頼性の高いAIモデルの設計が重視されます。

安全と公正の担保:人間中心、信頼性の高いAIを前提とし、AIによる誤認や不当な差別(偏見)、情報漏えいといったリスクに対応するガイドラインの整備(「AI法」の整備など)が進んでいます。この結合により、計量制度は単なる「取引の規律」から、「スマート製造と信頼性の高いデータ社会を支える基盤」へと進化しようとしています。

計量制度と人工知能の結合(2)

計量制度と人工知能(AI)の結合は、従来の「物理的な検定・検査」から、デジタル技術を駆使した「データの信頼性担保と高度な運用効率化」へと大きく舵を切っていくことになります。

主な方向性は以下の3点に集約されます。

1. 法定計量のデジタルトランスフォーメーション(DX)

従来の2年に1回といった定期的・物理的な検査から、AIを用いたリモート監視や異常検知への移行が進んでいます。

自動検針と異常検知:スマートメーター(電力、水道、ガス)とAIを組み合わせることで、計量データの推移から計量器の不具合や不正をリアルタイムで検知し、検査の合理化を図っています。

アジャイルなガバナンス:技術革新が速いAI分野に対応するため、固定的な法令だけでなく、運用状況に応じてガイドライン等を柔軟に更新する「アジャイルなガバナンス」が計量行政にも取り入れられていくことになります。

2. 「自動はかり」等へのAI実装と制度適応

製造・物流現場で多用される「自動はかり」において、AIによる高度な制御と正確な計量の両立が求められています。

検定義務化の進展: 2024年4月から始まった「自動捕捉式はかり(ウェイトチェッカ等)」の検定義務化に伴い、2027年3月の経過措置終了に向けて、AIを活用した自己診断機能を持つ計量器の導入が加速しています。

3. 計量データの価値創出(AIによる分析・活用)

計量制度の枠組みで担保された「正確なデータ」を、AIが社会課題の解決に活用する動きがあります。

社会課題解決への寄与:AIが正確な計量データを分析することで、インフラの老朽化診断や、少子高齢化社会における高齢者の「見守りサービス」(水道使用量からの異常察知など)といった付加価値サービスが提供されています。

:2025年に制定された「AI法(人工知能関連技術の研究開発及び活用の推進に関する法律)」に基づき、AIが出力する結果の根拠となるデータの正確性(計量標準)を確保する重要性が再認識されています。

今後、計量制度は単に「正しく量る」ためのルールから、AI社会を支える「信頼できるデータ基盤」としての役割を強めていくことになります。

├

├

├

├計量計測データバンク ニュースの窓-337-人工知能(AI)文章の欠点とAI活用の心得

├計量計測データバンク ニュースの窓-338-CPUとソフト機能の向上が計量(制度)にもたらす影響を推測する 夏森龍之介

├計量計測データバンク ニュースの窓 目次

├ 「日本計量新報」今週の話題と重要ニュース(速報版)2026年1月22日号「日本計量新報週報デジタル版」

├

├AIとは

AI(エーアイ)とは「Artificial Intelligence(人工知能)」の略で、コンピューターが人間のように学習・推論・判断・認識・問題解決などを行う技術の総称です。大量のデータを分析し、パターンやルールを見つけ出して賢くなり、翻訳、自動運転、音声アシスタント、画像認識など、様々な分野で活用されていますが、人間のような総合的な判断力はまだ持たない「特化型AI」が主流です。

AIの主な特徴

学習能力: データから自ら学び、精度を高めます(機械学習・深層学習)。

知的活動の模倣: 人間の知的な作業(言語理解、推論、予測など)をコンピューターで実現します。

タスク特化型: 現在のAIのほとんどは特定の分野に特化した「弱いAI(特化型AI)」です。

身近なAIの例

スマートフォンの音声アシスタント(Siri, Googleアシスタントなど)

自動翻訳アプリ

ECサイトのおすすめ商品表示

自動運転技術

医療画像の診断支援

仕組み(学習の例)

データ収集: 大量の画像、文章、音声などのデータを集めます。

学習: そのデータから「猫」や「犬」などの概念を学習し、特徴を捉えます。

判断・予測: 新しい画像を見たときに、それが猫か犬かを判断したり、画像からテキストを抽出(OCR)したりします。

AIの種類(概念)

弱いAI(特化型AI): 特定のタスク(画像認識、ゲームなど)に特化。現在の主流。

強いAI(汎用型AI): 人間のようにあらゆる知的タスクをこなせるAI。まだ実現していない。

AIは私たちの生活や仕事を効率化し、新しい価値を生み出す革新的な技術として、今後も発展が期待されています。

AI(人工知能:Artificial Intelligence)とは、「人間の知的能力をコンピュータなどで再現したソフトウェアやシステム」を指します。

2026年現在、AIは単なる自動化ツールを超え、学習・推論・判断・創造といった高度な機能を備え、社会のあらゆる場面で活用されています。

1. 主な種類

生成AI (Generative AI): 文章、画像、音楽、動画などを生成するAI。ChatGPT (OpenAI)、Claude (Anthropic)、Gemini (Google) などが例として挙げられます。

特化型AI: 将棋、自動運転、診断支援、翻訳など、特定のタスクを実行する AI。

汎用AI (AGI): 人間のように幅広い分野の問題を解決できる AI。2026年時点では研究開発が進められています。

2. 基本的な仕組み

AIは、大量のデータからパターンを学習する「機械学習 (Machine Learning)」や、人間の脳の仕組みを模倣した「ディープラーニング (深層学習)」という技術を使用しています。これらの技術により、AIはデータからルールを抽出し、高い精度で予測や生成を行うことが可能になります。

3. 社会での役割

効率化: 定型業務の自動化や、大量のデータ分析。

創造の支援: プログラミング、執筆、デザインにおけるアイデア創出。

課題解決: 医療における早期発見、環境問題のシミュレーション、パーソナライズされた教育。

AIは急速に進化を続けており、現在は「どのように効率的に活用するか」という利用方法に加え、AIの倫理、安全性、著作権などのルール作りも重要な課題となっています。

├

├人工知能 - Wikipedia

├

├【完全マスター】AI初心者にオススメ「Gemini」の使い方・基礎を徹底解説!

├AI時代の「哲学」―哲学は人工知能から何を学ぶか|谷川嘉浩×三宅陽一郎×宇野常寛

├AIと人間の境界線―AIとは何か そして人間とは何か|平野啓一郎×三宅陽一郎×宇野常寛

├

├【養老孟司】AIが奪うのは「仕事」ではなく「思考」かもしれない──養老先生が語る人間の未来。

├【養老孟司】この考え方をする人はバカです。AIは我々人間を支配しません。

├【養老孟司】「AIが人間に似る」という勘違い

├【養老孟司】※今話題のAIに仕事が奪われる未来ほ本当に来るのか?※ ChatGPTなどのAI化がどんどん進む中、人類はどう備えるべきか?【ラジオ/ながら聞き推奨】

├【養老孟司】AI社会,現代社会に対する問題について養老先生が解説します。

├【養老孟司氏に学ぶ】AIの時代をいかに生き抜くか!?今後の人生のヒントとして...

├(113) 【養老孟司】お前達は何を言ってるんだ?概念について理解できていない人が多過ぎます。 - YouTube

├【養老孟司】この動画に辿り着いた人だけが聞ける養老先生の講演です。

├【養老孟司】養老先生が記憶を無くされました。その経験をお話します。

├

├【バカの壁人生の壁】人生の師匠 養老孟司を語る 茂木健一郎(脳科学者)

├養老孟司先生に「AIってどう思いますか?」とお聞きした結果

├

├

├シンボル操作能力とは

シンボル操作能力(symbol manipulation ability)は、一般的に「記号を操作する能力」を指します。これは、記号、言葉、数字、イメージなどの抽象的な表現を理解し、操作し、適用する認知的なスキルセットを包括する概念です。

この能力は、人間特有の高度な思考プロセスや、近年の人工知能(AI)における重要な研究分野に関連しています。

主な側面と定義

認知的観点: 人間が言語(言葉)、論理(数字や記号)、視覚的イメージ(図形や地図)を用いて世界をモデル化し、問題を解決する能力です。例えば、数学の方程式を解く、言語を操る、推論を行うといった活動は、すべてシンボル操作能力に依存しています。

人工知能(AI)の観点: 初期から中期のAI研究において中心的なアプローチであった「記号主義AI(Symbolic AI)」の中核をなす概念です。このアプローチでは、世界の知識を記号(シンボル)で表現し、これらの記号を論理的なルールに従って操作することで知的な振る舞いを実現しようとしました。

コンピュータサイエンス: コンピュータがデータ構造やアルゴリズムを処理する能力も、広義にはシンボル操作と見なせます。

具体的な応用例

言語処理: 文章を読んで意味を理解し、新しい文脈で言葉を使う能力。

数学と論理: 複雑な数式を解いたり、証明を行ったりする能力。

推論と意思決定: 与えられた情報(記号)から論理的な結論を導き出す能力。

シンボル操作能力は、人間の知能や創造性の基盤をなす基本的な認知能力の一つと考えられています。

├

├シンボル操作とは

特徴:「AならばBである」といった論理的なルールをコンピュータに教え込み、推論を行わせます

シンボル操作(Symbolic Manipulation / Symbol Manipulation)とは、文字、数字、数式、論理記号などの「記号(シンボル)」を、あらかじめ決められた一定の規則(ルール)に従って変形・処理することを指します。主な分野での意味合いは以下の通りです。1.コンピュータサイエンス・数学 数値そのものを計算するのではなく、数式やプログラムの構造を記号として扱うことを指します。数式処理:例えば、\(x+x\)を\(2x\)と書き換えたり、方程式を解いたり、微分・積分を記号のまま実行することです。プログラミング:ソースコードを解析し、最適化したり別の言語に変換したりする作業もシンボル操作の一種です。2.人工知能 (AI) 「人間は言葉や概念(記号)をルールに基づいて操作することで思考している」という考え方に基づいたAIの手法を記号的AI(シンボリックAI)と呼びます。特徴:「AならばBである」といった論理的なルールをコンピュータに教え込み、推論を行わせます。対比:近年主流のディープラーニング(データからパターンを学ぶ「コネクショニズム」)とは異なり、中身の処理が人間にも理解しやすい(説明可能である)という特徴があります。3.心理学・認知科学 人間が言語や数学的記号を使って、抽象的な概念を操作したり論理的に考えたりする認知過程を指します。関連リンク:数式処理システム (Wikipedia)記号接地問題(シンボルグラウンディング問題)について:AIが記号の意味を現実世界と結びつけられるかという重要な課題。

├

├KAKEN — 研究課題をさがす | チンパンジーとヒトにおけるシンボル操作-人工言語習得研究の展開- (KAKENHI-PROJECT-06451017)

本研究では、アイ・アキラと名づけられた「言語」習得訓練を受けてきた2頭のチンパンジーと、未経験の若いチンパンジー4頭の計6頭のチンパンジーを主たる対象として、チンパンジーのもつ認知機能を「シンボル操作」の階層構造という視点から捉え、ヒトとの比較において理解することを目的とした。シンボルの操作は、まさにヒトをヒトたらしめているきわめてヒトに特異な能力だからである。シンボル操作のトピックスとしては、ストループ効果(視覚シンボルのもつ言語的意味と知覚的見えのあいだの相互作用)について検討した。

人工言語習得の研究を継続してきたアイ17歳、アキラ17歳と、さまざまな見本合わせ課題の経験をもつ4頭のチンパンジー(ペンデ-サ16歳、クロエ13歳、ポポ11歳、パン10歳)を主たる対象として、ヒト幼児からおとなまでを対象とした比較研究により、以下に述べるシンボル操作の階層性を実験的に分析した。シンボル操作を検討する汎用の実験装置は、コンピューター本体に、ハイパータッチとよばれる新しいタッチパネルシステムと画像処理装置を組みあわせた刺激提示・反応記録装置をもちいた。そのために必要なインターフェスについては自作した。シンボル操作と概括する上述の高次認知機能をひきだす場面は、具体的には見本合わせ場面(同一見本合わせ、象徴見本合わせ、構成見本合わせ、遅延見本合わせなど、およびそれらの複合課題)である。10色を色名図形文字と色名漢字の両方で表現できるようにチンパンジーを訓練し、ストループ干渉の予備実験をおこなった。

├

├

├AIが作り出している文章 AIが作り出している動画や画像 騙されているようで居心地が悪い

├

├ハルシネーション (人工知能) - Wikipedia

ChatGPTは、不正確または欠落した参考資料を提供するだけでなく、一部の参考資料の内容を幻覚的に表示するという問題もある。ChatGPTが提供した合計115の参考資料を分析した調査では、そのうち47%が捏造されたものだった。さらに46%は実際の参考資料を引用していたが、そこから誤った情報を抽出していた。残りの7%の参考資料のみが正しく引用され、正確な情報を提供していた。ChatGPTは、多くの誤った情報を「二重に利用」していることも観察されている。幻覚による可能性のある間違いについてChatGPTに質問すると、ChatGPTは自分自身を訂正しようとすることもあるが、回答が正しいと主張し、さらに誤解を招く情報を提供することもある。├

├言語モデルでハルシネーションがおきる理由 | OpenAI

OpenAI では、AI システムをより便利で信頼性の高いものにするために日々努力しています。言語モデルの能力は進化し続けていますが、完全に解決するのが非常に難しい問題が1つ残り続けています。それがハルシネーションです。ハルシネーションとは、モデルが正しくない回答を自信を持って生成するという現象です。当社の新しい調査報告(新しいウィンドウで開く)では、言語モデルでハルシネーションがおきる理由は、標準的な学習と評価の手順により、不確実性を認めるよりも、当て推量のほうに報酬が出るためだと論じています。

ChatGPT でもハルシネーションは発生します。GPT‑5 は特に推論において、ハルシネーションが著しく低下していますが、それでもハルシネーションは発生します。ハルシネーションは引き続きすべての言語モデルにとって根本的な課題であり、OpenAI ではハルシネーションをさらに減らすべく取り組んでいます。

ハルシネーションとは何か?

ハルシネーションとは、言語モデルが生成する、もっともらしく聞こえるが正しくない発言のことです。一見単純に見える質問に対してでさえ、ハルシネーションが予想もせずおきる場合があります。たとえば、人気のあるチャットボットに Adam Tauman Kalai(本報告書の著者)の博士論文のタイトルを尋ねたところ、自信を持って3つの異なる回答が提示されましたが、どれも正しくありませんでした。彼の誕生日を尋ねたところ、3つの異なる日付が提示され、やはりどれも正しくありませんでした。

テスト対策

ハルシネーションがなくならない理由の1つが、現在の評価手法では間違ったインセンティブが設定されていることです。評価自体がハルシネーションの原因になることはありませんが、多くの評価におけるモデルのパフォーマンス測定方法が、不確実性に対する誠実さよりも推測を推奨するようになっています。

これは多肢選択のテストのようなものです。答えがわからなくても、運が良ければ当てずっぽうで正解になるかもしれません。空のままにすれば間違いなくゼロ点です。これと同じように、モデルを正確性、つまり正しく回答した質問の割合についてのみ評価すると、モデルは「分かりません」と回答する代わりに推測することを選ぶようになります。

もう1つの例として、言語モデルに誰かの誕生日を尋ねたときに、モデルは誕生日を知らないとします。「9月10日」と推測した場合、正解になる確率が365分の1あります。「分かりません」と回答すればゼロ点です。数千のテスト質問を重ねると、スコア上は、不確実性を認める慎重なモデルよりも、推量を行うモデルの方が良く見えてしまいます。

「正解」が1つだけ存在する質問の場合、回答には、正解、間違い、モデルが推量を犯さない棄権の3つのカテゴリーが考えられます。棄権は謙遜の一部で、OpenAI のコアバリューの1つです。ほとんどのスコアボードでは正確性に基づいてモデルを優先付け・ランク付けしますが、間違いは棄権よりも問題です。当社の Model Spec(新しいウィンドウで開く) では、不正確である可能性がある情報を自信を持って提供するよりも、不確実性を示す、あるいは質問内容を明確にすることを求める方が優れていると示しています。

具体的な例として、GPT5 System Card(新しいウィンドウで開く)のSimpleQA 評価を考えてみましょう。

測定基準

gpt-5-thinking-mini

OpenAI o4-mini

棄権率

(具体的な回答を提示しない)

52%

1%

精度

(正解、高いほど良い)

22%

24%

エラー率

(不正解、低いほど良い)

26%

75%

合計

100%

100%

正確性の点では、古い OpenAI o4-mini モデルの方が少し良いパフォーマンスを示しています。ただし、そのエラー率(ハルシネーションの割合)は非常に高くなっています。不確かな場合に戦略的に推測することで正確性は向上しますが、エラーとハルシネーションが上昇します。

数十の評価での結果を平均するときは、ほどんどのベンチマークでは正確性の指標を取り出しますが、そうすると正誤の間での誤った二分法が発生します。SimpleQA のような非常に単純な評価では、一部のモデルはほぼ100%の正確性を達成するため、ハルシネーションが排除されます。ただし、より難易度の高い評価や実際の使用においては、正確性の上限は100%を下回ります。これは、一部の質問では、入手不可能な情報、小規模モデルの思考能力の制限、明確にする必要がある曖昧さなどのさまざまな理由から、回答を決定できないためです。

それにもかかわらず、正確性のみのスコアボードがリーダーボードやモデルカードを独占しているため、開発者は自制するよりも推量するモデルを構築するように動機付けられます。これが、モデルがより進歩しているにもかかわらず、いまだにハルシネーションをおこす理由の1つであり、不確実性を認める代わりに間違った回答を自信を持って提供してしまうのです。

評価を採点するより適切な方法

明快な修正方法があります。自信を持った間違いに不確実性よりも多くのペナルティを課すのです。さらに、不確実性を適切に表現した場合に点数の一部を与えます。これは新しいアイデアではありません。一部の標準テストでは長い間、不正解にマイナスのスコアを与えたり、答えを空のままにした場合に点数の一部を付与することで、当て推量をやめさせるようにしています。いくつかの調査グループではさらに、不確実性や校正を考慮に入れる評価を検討しています。

当社の視点は異なります。不確実性に対応した新しいテストをいくつか追加するだけでは不十分です。広く使われている正確性ベースの評価を更新して、そのスコアリングで推測を抑えるようにする必要があります。主要なスコアボードが運の良い推測を評価し続ければ、モデルは推測することを学習し続けます。スコアボードを修正することで、新しく開発された、また以前の調査から分かったハルシネーション削減の手法がより多く採用されるようになります。

次の言葉の予測からハルシネーションがいかに生じるか

ハルシネーションを排除することがいかに難しいかについて説明してきましたが、このような非常に具体的な事実に関する不正確さはそもそもどこから生じるのでしょうか。なんといっても、大規模な事前トレーニング済みのモデルでは、スペルミスや一致しない括弧などの他の種類のエラーはほとんどおきません。違いは、データ内に存在するパターンに関係していると考えられます。

言語モデルは最初に事前トレーニングを通じて学習します。これは大量のテキストの次の単語を予測するプロセスです。従来の機械学習の問題とは異なり、それぞれの文章に「正/誤」のラベルは付けられていません。モデルは単に流暢な言語の肯定的な例を確認するだけで、全体的な分布を概算します。

無効のラベルが付けられた例がない場合に、有効な文章と無効な文章を区別することはさらに難しくなります。ただし、ラベルが付けられていたとしても、一部のエラーは不可避です。その理由を理解するために、単純な例を考えてみます。画像認識において、数百万の猫と犬の写真に「猫」または「犬」のラベルが付けられていれば、アルゴリズムは猫と犬を確実に分類するように学習することができます。ところが、それぞれの写真にペットの誕生日のラベルが付けられていたらどうでしょうか。誕生日は基本的にランダムなので、アルゴリズムがいかに進化しても、このタスクでは常にエラーが生成されます。

同じ原則が事前トレーニングにも当てはまります。スペルや括弧は一貫性のあるパターンに従っているため、それらのエラーはほとんどなくなります。ところが、ペットの誕生日など、頻度の低いランダムな事実は、パターンからだけでは予測することができないため、ハルシネーションにつながります。当社の分析は、次の単語の予測からどのような種類のハルシネーションが発生するかを説明しています。理想的には、事前トレーニング以降の追加ステージでハルシネーションが除去されるはずですが、前のセクションで説明したような理由でこれは完全にはうまくいきません。

結論

当社の報告で示した統計的な事実により、ハルシネーションの性質をあきらかにし、以下のような一般的な誤解が解消されることを願っています。

主張:100%正確なモデルは決してハルシネーションをおこさないので、正確性を向上させればハルシネーションは除去される。

調査結果:モデルのサイズ、検索および推論の能力にかかわらず、正確性が100%に達することは決してない。なぜなら、現実の世界の一部の質問は本質的に回答不可であるためである。

主張:ハルシネーションは防ぎようがない。

調査結果:防ぐことはできる。言語モデルは不確かな場合、回答を控えることができます。

主張:ハルシネーションを回避するには、大規模モデルでのみ達成可能な度合のインテリジェンスが必要になる。

調査結果:小規模モデルのほうがその限界を把握するのがより簡単である。たとえば、マオリ族について回答するように質問された場合、マオリ族を知らない小規模モデルでは単に「分かりません」と回答できますが、マオリ族について多少の知識がある大規模モデルではその信用度を判断する必要があります。報告書で説明しているとおり、校正するために必要な計算能力は正確であるために必要な計算能力よりもずっと少なくて済みます。

主張:ハルシネーションは最新の言語モデルにおける神秘的な現象である。

調査結果:ハルシネーションが発生する、評価で報酬が付与される統計的メカニズムが解明された。

主張:ハルシネーションを測定するには、優れたハルシネーション評価があればよい。

調査結果:ハルシネーション評価は公開されていません。ただし、謙遜を罰し、推測を評価する何百もの従来の正確性ベースの評価では、適切なハルシネーション評価の効果はほとんどありません。その代わりに、すべての主要な評価指標を見直して、不確実性を表明することを評価する必要があります。

OpenAI の最新モデルではハルシネーションの割合が低下しており、当社の言語モデルが自信をもって出力するエラーの割合をさらに下げるように引き続き取り組んでいます。

├

├なぜ生成AIが書いた文章に違和感が生まれるのか?:malna株式会社

https://malna.co.jp/blog/why_genai_writing_feels_off/

「生成AI なぜ生成AIが書いた文章に違和感が生まれるのか

writer 野中力斗

consultant

デジタルマーケティング全般を担当。SEOの戦略設計と実行、コンテンツ制作、SalesforceやHubSpotなどのマーケティングオートメーションツールの運用、データ分析を通じた成果改善に注力。2023年よりmalna株式会社に参画し、多角的なアプローチでクライアントの成長を支援。2025.04.05

生成AI

なぜ生成AIが書いた文章に違和感が生まれるのか?

AIツールの普及は目覚ましい勢いで加速しており、MicrosoftとLinkedInが2024年5月に公開したデータによれば、職場でのAI利用率は日本においては32%に達しているものの、世界全体の75%という数値と比較すると著しく低い状況です。しかしながら、今後この利用率は確実に上昇するものと予測されます。加えて、世界のAIライティング市場は現在2億9,314万米ドルと評価されており、2030年までには5億2,629万米ドルという規模に到達すると見込まれています。

こうした革新的なツールは文書作成の劇的な効率化をもたらす反面、生成された文章には独特の「AIっぽさ」が残存することが深刻な課題となっています。過度に形式的な表現や不自然に均一な文体、そして人間特有の機微や個性を欠いた文章構成は、専門家でなくとも強い違和感として察知されるようになってきました。驚くべきことに、これらの「AIの痕跡」は、マーケティングコンテンツの信頼性や説得力を著しく損なう恐れがあるのです。

本記事では、AIを創造的に活用して執筆される方々に向けて、文章から滲み出るAI感とはいったい何なのか、また、AIの優れた能力を最大限に引き出しつつ、成果を生み出すコンテンツライティングの手法をご紹介します。

参考:Microsoft,LinkedIn. “2024_Work_Trend_Index_Annual_Report”

参考:AIライティングアシスタントソフトウェア市場| 市場規模 分析 予測 2025-2030年 【市場調査レポート】

目次

なぜ今この問題が重要なのか

検索エンジンのアルゴリズムは絶え間なく進化を続けており、Googleは「真に有益なコンテンツを提供すること」を評価基準の核心に据えています。2024年に実施された画期的なGoogleコアアップデート以降、AIによる機械的な大量生成コンテンツへの評価は格段に厳格化されており、明確にAIが作成したと判断されるコンテンツは検索順位が急落するリスクが非常に高まっています。

さらに注目すべきは、現代の読者のメディアリテラシーが驚異的に向上している点であり、「AIが書いた」と直感的に感じるコンテンツに対する感受性も極めて鋭く研ぎ澄まされてきています。世界17カ国を対象としたYouGovの調査によれば、実に約50%もの消費者が、AIを駆使してブランドアンバサダーを創出したり広告画像を生成・編集したりするブランドに対して強い不快感や不信感を抱いているという衝撃的な結果が示されています。

このことから明らかなのは、単純にAIを導入すれば良いというわけでは決してなく、「AIらしさを微塵も感じさせない形でAIを巧妙に活用する高度な技術」こそが、現代のマーケティング活動の成否を根本から分ける決定的な要素となっているという事実です。これは表面的な文章の美しさの問題を遥かに超え、企業のビジネス成果に直結する極めて重大かつ緊急の課題と言えるでしょう。

参照:YouGov

自社に最適な生成AIを導入するなら、malna株式会社へ

malna株式会社では、「AIらしさを感じさせないコンテンツ制作」をはじめ、生成AIの最適な導入・活用をご提案し、貴社のマーケティング活動を一貫してサポートしています。

社内でも生産性が30%アップした実例をもとに、AI活用のノウハウを提供

テクノロジー/マーケティング視点を持った専門家が直接支援

AIの導入/定着まで一気通貫でご支援

まずは無料相談にて、社内導入の流れや貴社の現在のお悩み等、お気軽にご相談ください。

AIの文章はなぜ違和感を覚えるのか

AIが生成する記事を読むと、どこか居心地の悪い違和感を覚えることはありませんか?この違和感は、主に「表現の不自然さ」と「内容の不正確さ」という二つの側面から生じています。AIが統計的な見地から使用される可能性が高い単語を選択するため、文章全体の文脈を考慮できず、不自然なつながりが生じることがあります。これは、AIの文脈理解やニュアンスの把握が不十分であるという表現上の問題です。

一方で、情報の正確性や信頼性は全く別の問題であり、AIが提供する内容自体の品質に関わります。学習データの偏りやデータに現れないバックグランドを理解していないことが、この両方の問題の根底にあります。

こうした要因により、AIの文章は私たちが心の奥で期待する自然な響きや創造性、そして何より信頼できる正確さからかけ離れてしまうことがあるのです。以下では、AIが紡ぎ出す文章に違和感を覚える原因を、表現と内容の両面から掘り下げていきます。

表現面の問題:LLMの仕組みの問題

AIライティングツールは「トークン」という小さな言語単位で文章を紡いでいきます。これは単語や句読点などの意味の塊であり、これをもとに統計的に使用される確率の高い文章を作ります。しかし、人間は文章を書く際、全体のテーマや文脈を念頭に置いて単語を選びます。この根本的な違いにより、AIが作る文章は時に不自然なつながりや文脈のずれが生じます。

例えば「朝ごはんをモリモリ食べてから元気に学校へ向かった」の後に、唐突に「政治的問題は現代社会において重要な課題です」という一文が続くような、前後の文脈を無視した生成が起きることがあります。これは内容の正確さとは別の、文章の自然な流れに関する問題です。

表現面の問題:画一的な表現パターンを繰り返す

AIは学習データから「最も安全で無難な表現」を選びがちです。そのため、個性的な言い回しや鮮烈なフレーズが乏しく、何とも言えない「既製品感」「マニュアル感」を醸し出します。

特に私が気になるのは「〜と考えられます」「〜することが望ましいでしょう」といった決まり文句や、トンマナを考慮して文章を生成できないことです。読んでいて「あれ?これどこかで見たような…」という既視感で、この表現上の特徴は、内容が正確であっても、文章としての魅力や個性は感じられないでしょう。

表現面の問題:文脈に対して適切な生成ができない

AIが文脈理解に失敗する典型例として、冗談や比喩表現を文字通りに解釈してしまうことがあります。「財布が悲鳴をあげている」という表現を「財布が実際に音を出している」と誤解するケースや、「明日の予定がパンパンに埋まっている」という表現を、予定が物理的に満員で動けないと捉え、不適切なフォローアップをする場合もあります。

これらは人間が自然に理解できる文脈ごとのニュアンスをAIが捉えきれないために生じる、表現の自然さに関わる問題です。

表現面の問題:感情表現の平板さに物足りなさを感じる

AIの生成文章は、感情表現を形式的に処理するため、不自然になることが多くあります。

AIの文章における感情表現は、どこか形式的で心に響かないことが少なくありません。感動的な場面で「とても感動しました」「心から嬉しく思います」といった平板な表現が繰り返されると、なんとも物足りなさを感じてしまいます。

対照的に、人間の書き手なら「胸が熱くなり、思わず目を閉じた」「全身に喜びが広がり、足が地面から浮くような感覚だった」といった生々しい感覚表現で読者の心を揺さぶることができるのです。AIの感情表現の薄さは、あたかも素晴らしい風景を白黒写真でしか見られないような物足りなさを私に与えます。

内容面の問題:情報の信頼性が担保できない

表現の不自然さとは別に、私が深く懸念するのはAIが提供する情報自体の質や正確性です。専門分野の話題を扱う際、AIはしばしば一般論に終始し、本当に必要な具体的な注意点や専門知識を欠いていることがあります。

医療情報を例にとると、「バランスの良い食事が大切です」という誰もが知っている一般論ではなく、特定の症状や体質に合わせた具体的な食事のアドバイスこそが価値あるものです。

さらに問題なのは、AIが誤った情報を自信満々に提供してしまう「ハルシネーション」の問題です。これは表現の自然さとは全く別の次元の、内容の正確性に関わる深刻な問題であり、信頼性を根底から揺るがします。

専門的な判断が必要な場面や事実確認が重要な状況では、この問題に直面せざるを得ません。

このように、AIの文章に対する違和感は「どのように語られているか」という表現の質と、「何が語られているか」という内容の質という、まったく異なる二つの層から生じているのです。両者は容易に混同されがちですが、異なる問題として認識し対処していくことが、AI文章の品質向上には不可欠だと私は強く感じています。

AIライティングの限界と相性の悪い領域

AIライティングには明らかな限界が存在し、とりわけ「人間らしさ」が価値の核心となる分野では活用が困難なことは否めません。この視点から、AIとの相性が芳しくない業種や状況について考察してみましょう。

人が商材そのものとなるビジネス

コンサルタント、ライター、クリエイティブ職など「その人自身」が価値の要となる職種では、AIの導入が特に難しいと感じます。クライアントは特定の人物が持つ独特の眼差しや思考回路に魅了され、対価を支払うのです。その人だけが持ちうる専門知識や業界での実体験に基づく洞察は、AIでは到底再現できません。数十年にわたり培われた経験値や、特定の分野での深い専門性が生み出す独自の視点には価値があります。

ブランドの「熱」や「想い」を伝える文脈

創業物語やビジョン、ミッションを語る場面では、AIが紡ぎ出す文章からは、その本質的な深みや熱量が十分に伝わりません。起業家が幾多の困難を乗り越えた道のりや、製品開発に込めた思いの深さ、あるいは情熱など、言葉の背後にある「人間的な温度」をAIは適切に表現できないのです。

また、言葉が息づく状況ごとに変容するニュアンスや背景を適切に描き出せないのが現状です。例えば、日本語の「もったいない」という言葉には、物質的な無駄だけでなく、機会損失や感謝の念、さらには畏敬の感情まで含まれますが、こうした文化的・歴史的背景を踏まえた適切な言葉の選択と文脈への埋め込みは、AIにとって大きな挑戦です。

特にブランドストーリーを国際的に展開する際、文化的ニュアンスを保ちながら異なる言語圏の人々に響く表現を選ぶ繊細さは、人間のライターの真骨頂といえるでしょう。

人間の感情や洞察が不可欠な分野

特に心理カウンセリング、芸術、文学などの領域では、AIの限界が際立って見えます。小説や詩では、繊細な感情の揺らぎや情景の描写が求められますが、AIでは表現しきれないことが多いのです。

例えば村上春樹の小説に見られる現実と非現実の境界を曖昧にする描写や、川端康成の「雪国」冒頭の「国境の長いトンネルを抜けると雪国であった」という一文が喚起する視覚的・心理的な転換の妙は、単なる言語モデルでは捉えきれない文学的深みを持っています。

人間の複雑な感情や直感的洞察力が求められる場面では、AIが生成する表層的な内容では物足りなさを感じるでしょう。例えば心理カウンセリングの現場では、クライアントの言葉の選択や間、声のトーン、表情の微妙な変化などから本当の気持ちを読み取る洞察力が不可欠です。

同様に、文芸批評や芸術評論の分野でも、作品の表面的な分析を超え、時代背景や作家の人生経験、社会的文脈を踏まえた深い解釈が求められます。こうした「言葉の向こう側」を読み取る能力は、AIにとって最も獲得が難しい領域でしょう。

AIライティングは数多くの領域で効率化という恩恵をもたらしますが、「人間らしさ」が価値の中核を成す分野では、人間のライターの存在意義はむしろ高まっているように思います。特に独自の視点や情感あふれる表現、ブランドの熱い想いを伝える場面では、AIではなく人間の手による文章が、これからも大切な役割を担い続けるでしょう。

AIライティングはどこまで活用できるのか

それでは、どういった場面でAIを活用した記事の制作が出来るのでしょうか。それは、大量のデータから必要な情報を迅速に抽出し要約する作業において、AIはその力を発揮します。また、定型的な業務文書(報告書、プレスリリース、商品説明など)の作成では、人間が一から書くよりも効率的に質を高めることができます。さらに、SEOに最適化された記事の下書きを迅速に生成することも得意であり、人間が編集・調整を加えることで、最終的な完成度を向上させることが可能です。

生成AIがライティングに向いている領域

AIライティングが最も得意とするのは、以下のような定型的な文章です。

リサーチ・要約

膨大なデータから必要な情報を抽出し、簡潔にまとめることが得意。

定型フォーマットの文書作成

プレスリリース、報告書、商品説明など、型が決まっている文章の作成。

SEO記事の基礎作成

キーワードを含めた記事の下書きを作成することが可能。

翻訳や表現の統一

多言語対応やスタイルの統一を瞬時に整えることが可能。

人間が担うべき領域

一方で、AIが苦手とする分野もあります。特に以下の要素を含む文章は、人間の手による調整が不可欠です。

クリエイティブな表現

独自性や情感を伴う表現は不得意。

ストーリーテリング

読者の共感を呼ぶストーリーを作るには、バックグラウンドの理解に乏しいAIには困難。

感情や熱量を伝える文章

ブランドの理念や想いを表現するのは苦手。

専門的なニュアンスの調整

業界特有の言い回しや専門家向けの文章は、細かな調整が必要。

自社に最適な生成AIを導入するなら、malna株式会社へ

「AIを導入したいが、成果に繋がるか不安」とお悩みの方は、弊社の支援をご利用ください。

malna株式会社では、生成AIの専門家が、貴社の実現したい内容を基に、最適なAI導入のご提案とご支援を行っております。

社内でも生産性が30%アップした実例をもとに、AI活用のノウハウを提供

テクノロジー/マーケティング視点を持った専門家が直接支援

AIの導入/定着まで一気通貫でご支援

まずは無料相談にて、社内導入の流れや貴社の現在のお悩みをお聞かせください。

AIを使いつつ、自然な文章にする方法

AIライティングを活用しながら、より人間らしい自然な文章を作るための工夫を紹介します。ぜひ参考にしてください。

AIを下書きにして、人間が手を加える

AIが作成した文章は、情報整理やベース作りには便利ですが、そのままでは機械的な印象を与えがちです。下書きとして利用し、最終的な仕上げは人間が責任をもって実施しましょう。

AIが生成した文章の流れを見直し、冗長な部分を削る。

適切な比喩表現や具体例を追加し、読者が理解しやすい形に整える。

具体的なエピソードを加える

実際の経験談や実例を盛り込むことで、「AIっぽさ」を消し、読者の共感を得やすくなります。

たとえば、AIが「製品が人気だ」と述べるだけではなく、「販売開始から3日で完売し、SNSでも話題になった」といった具体例を盛り込むことで、リアルで説得力のある文章に仕上げることができます。

また、「嬉しかった」と表現するだけでなく、「長年挑戦していた資格試験にようやく合格した瞬間、思わず涙があふれた」という具体的な感情の動きを入れることで、読者はより強く共感できます。

リズムの変化を取り入れる

文章にリズムを持たせることで、読者に飽きさせない工夫ができます。

例えば、長文の後には短文を入れたり、固い説明文の後にはカジュアルな一文を挟むなど、意図的にテンポを変えることで、「AIっぽさ」の原因となる画一的なリズムを避けられます。

例として以下の文章が挙げられます。

長めの説明文

「AIライティングは業務効率化に大きなメリットをもたらしますが、使い方を誤るとブランド価値を損なうリスクも伴います。」

続く短文

「だからこそ、注意が必要です。」

こうした変化を入れると、読み手が文章に引き込まれやすくなります。

プロンプトを工夫する

AIライティングの質は、プロンプトの作り方に大きく左右されます。具体的な工夫としては、AIにインプットする際に「参考記事や文献を具体的に示す」ことです。単にテーマを与えるのではなく、理想的な文章の例を事前に示すことで、AIが生成する文章の品質が大きく改善されます。

また、「初心者にもわかりやすく」「具体的なエピソードを含める」といった条件をプロンプトに明記することで、AIがより適切な文章を生成しやすくなります。

プロンプト例

冒頭にAIにロールを指示する

例:あなたはプロのライターです。

既存記事のトンマナと統一させたい場合は、参考記事をインプットさせる

例:以下の記事を検索し、文章のトーンや表現を忠実に再現しながら文章の形式を指示する

例:見出しを連続で生成せず、必ず本文を入れること

上記のプロンプトはすでにさまざまなサイトで取り上げられていますが、自分が使う用途に合わせてベストなプロンプトを探してみましょう。以下に筆者が活用するプロンプトを一部公開しますので、ぜひ活用してみてください。

プロンプト例

プロフェッショナルWEBライター指示書

◆ ライターロール

あなたには一流のWEBライターとしての役割を担っていただきます。以下の指示に従い、送付された文章を洗練された記事へと仕上げてください。

◆ 文章表現ガイドライン

1. 表現の多様性を追求

* 言葉の反復を避け、多彩な類義語と表現バリエーションを活用する

* 格調高い文体を基調としながらも、適宜洗練された軽やかさを取り入れ文章に起伏を持たせる

* 口語表現や話し言葉は使用せず、書き言葉としての品位を保つ

2. 感情表現の効果的活用

* 文脈に応じて感想や印象を表す言葉を戦略的に配置する

* 「〜と感じられます」「〜が印象的です」「〜に感銘を受けます」など、多彩な感情表現を織り込む

* 読者の共感を誘う表現で記事に温かみを与える

3. 文体と構成の洗練

* 「です・ます調」の丁寧体で全体を統一する

* 見出し直後には必ず本文を配置し、見出しの連続使用は避ける

* 段落間の論理的連続性を重視し、滑らかな文章の流れを構築する

* 適切な接続語を用いて文章間の結束性を高める

4. トーンとスタイルの調和

* 参照URLの文章特性(専門性・格式・親しみやすさ)を分析し、一貫したトーンを維持する

* 業界や専門分野に適した語彙と表現を選択する

* ターゲット読者層に最適化された親しみやすさと専門性のバランスを追求する

◆ 重要遵守事項

1. 原文の本質を保持する

* 内容の要約は行わず、原文の表現・言い回し・語り口の特徴を忠実に反映させる

* 元の文章が持つニュアンスと意図を最大限に尊重する

2. インタビュー内容の忠実な再現

* 面接内容、質問、回答については原文をそのまま、または会話形式で記載する

* 話者の個性や言葉遣いの特徴を維持する

3. 引用の明確な表示

* スクリプトから直接引用する場合は必ず引用符(「」)を使用する

* 引用部分と地の文を明確に区別する

4. 構造の維持と内容の充実

* カテゴリや見出し構造は原文のまま維持する

* 元のトークが持つ豊かさと深みを保ちながら文章を洗練させる

◆ 成果物の品質基準

* 読みやすさと情報の正確性を両立させた高品質なコンテンツ

* SEO最適化と読者体験を同時に満たす戦略的な表現

* プロフェッショナリズムと温かみのバランスが取れた魅力的な文章

▶ 編集/コピーする

今後のAIライティングの展望

AIライティングの今後の展望として、人間の価値を明確に発揮できる領域がより一層鮮明になっていくと考えられます。このような環境下において、人間のライターには、単なる情報の伝達を超えた、自身の経験や価値観を強く打ち出したコンテンツの提供が求められるようになるでしょう。さらに、AIを適切に管理し効果的に活用するための編集力や判断力も、極めて重要なスキルとして注目されていくことが予想されます。

AIと人間のハイブリッドライティングの時代

今後の潮流として、AIがライターを完全に置き換えるというよりも、「AIと人間の協業」が主流になっていくと考えられます。例えば、マーケティング分野においては、AIがデータに基づいた基礎的な記事を生成し、人間がそこに感情や創造性を加味して仕上げるという手法がすでに数多く実践されています。

実際に、多くの企業がAIに記事の下書きを任せ、その後、専門ライターが感情表現やブランドのストーリーを追加することによって、読者のエンゲージメントが顕著に向上したという成果を挙げています。この協業モデルは、効率性と質の両立を可能にする優れた方法として注目を集めています。

GoogleのAIコンテンツ評価の変化

検索エンジン最大手のGoogleは、今後ますますAI生成コンテンツに対する規制を強化していく可能性が高いと思われます。AIによって生成された無個性なコンテンツは、検索結果の順位を大きく下げられるリスクが増大しており、「誰が作成したコンテンツ」なのかという点がさらに重要視されるようになると考えられます。

SEOのトレンドはその時期によって変化しますが、執筆時の2025年においては、かつてのコンテンツマーケティング重視のトレンドから、ドメインパワーを重視する方向へと変化しつつあると感じられます。この点からも、どのようなサイトがコンテンツを公開しているのかという発信元の信頼性が評価される傾向が強まっていると言えるでしょう。

SEO対策においても、高い可能性で「Who(誰が)」の要素が重要視されるようになると予測されます。これは、コンテンツの背後にある専門性や信頼性が評価の鍵となることを示唆しています。

これからのライターの価値とは?

AIが台頭する時代において、ライターに特に求められるのは「オリジナリティ」や「独自の視点」です。情報そのものは変化を起こしづらく、多くのサイトが似通った内容を提供しがちです。今後は単に情報を伝えるだけでなく、その背景にある経験やストーリー、個性的な視点を提供できるライターこそが高い評価を受けるでしょう。

また、「AIを使いこなす技術」もライターの価値を大きく左右する要素となります。AIを下書き作成や情報整理に効果的に活用しつつも、自身の個性や専門性を文章に反映させることができるライターが、これからの時代を力強く生き抜いていくと考えられます。

そして、「あなた」というブランドが最終的に価値を見出す時代が到来するでしょう。類似したコンテンツが溢れる中、明確な差別化ポイントの一つとして、個人やチームのブランド力は今後ますます重要視されていくでしょう。

まとめ

AIライティングは効率的で便利な反面、文脈の深い理解や感情表現の不自然さ、情報の浅さや信頼性の低さなどが違和感を生む原因となります。そのため、AIが得意とするリサーチや定型文書作成などはAIに任せつつも、具体的なエピソードや読者が共感できる人間らしい表現を取り入れるなど、人間による工夫や編集が欠かせません。

今後はAIを単に「使う」のではなく、AIの特性を理解し、人間とAIの強みを融合したハイブリッドライティングが重要となり、これがコンテンツの信頼性や説得力を高める鍵となるでしょう。

malna(マルナ)では、このようなAI活用のご提案を含め、包括的なマーケティング支援を提供しております。クライアントの事業成長のために伴走したい、一緒に働きたいという方はぜひ、私とカジュアルに面談のお時間をいただけますと幸いです。

最後までお読みいただき、ありがとうございました。

├

├

├「なんか気持ち悪い…」AIで作ったものに覚える違和感こそが「人間の価値」そのものである訳 | リーダーシップ・教養・資格・スキル | 東洋経済オンライン

AIが作ったものが溢れる現代

AI時代に仕事と呼べるもの: 「あなただけ」の価値を生み出し続ける働き方

『AI時代に仕事と呼べるもの:「あなただけ」の価値を生み出し続ける働き方』(書影をクリックすると、アマゾンのサイトにジャンプします。紙版はこちら、電子版はこちら。楽天サイトの紙版はこちら、電子版はこちら)

最近は生成AIの普及によって、巷にはAIで作ったものが本当に多く溢れています。

AIで作ったイラスト、文章、そして最近は動画も、とてもたくさん流れるようになりました。

これはビジネスシーンでも同じです。提案資料、メールの文面、記事など、「ああ、これはAIで作られたな」というものがたくさんあります。

私自身もAIを使っていろんなものを作っていて、業務効率が数倍にアップしているという恩恵は確実に受けています。その際に最も注意しているのが、この「AIっぽさ」です。

├

├「生成AIによるフェイク情報」の本当の恐ろしさとは | 生成AI | ダイヤモンド・オンライン

人工知能やクラウド技術などの進化を追い続けている小林雅一氏の新著、『生成AI―「ChatGPT」を支える技術はどのようにビジネスを変え、人間の創造性を揺るがすのか?』が発売された。同書では、ChatGPTの本質的なすごさや、それを支える大規模言語モデル(LLM)のしくみ、OpenAI・マイクロソフト・メタ・Googleといったビッグテックの思惑などがナラティブに綴られており、一般向けの解説書としては決定版とも言える情報量だ。

この連載では、小林氏による書き下ろしで、ビジネスパーソンが押さえておくべき「AIの最新状況」をフォローアップ中だ。今回は、『生成AI』のなかでも取り上げられ、イスラエル・パレスチナ紛争などでも世界的に問題になった「生成AIによるフェイク情報」について解説する。

├

├「生成AIによるフェイク情報」の本当の恐ろしさとは | 生成AI | ダイヤモンド・オンライン

人工知能やクラウド技術などの進化を追い続けている小林雅一氏の新著、『生成AI―「ChatGPT」を支える技術はどのようにビジネスを変え、人間の創造性を揺るがすのか?』が発売された。同書では、ChatGPTの本質的なすごさや、それを支える大規模言語モデル(LLM)のしくみ、OpenAI・マイクロソフト・メタ・Googleといったビッグテックの思惑などがナラティブに綴られており、一般向けの解説書としては決定版とも言える情報量だ。

この連載では、小林氏による書き下ろしで、ビジネスパーソンが押さえておくべき「AIの最新状況」をフォローアップ中だ。今回は、『生成AI』のなかでも取り上げられ、イスラエル・パレスチナ紛争などでも世界的に問題になった「生成AIによるフェイク情報」について解説する。

├

├なぜ生成AIが書いた文章に違和感が生まれるのか?:malna株式会社

AIツールの普及は目覚ましい勢いで加速しており、MicrosoftとLinkedInが2024年5月に公開したデータによれば、職場でのAI利用率は日本においては32%に達しているものの、世界全体の75%という数値と比較すると著しく低い状況です。しかしながら、今後この利用率は確実に上昇するものと予測されます。加えて、世界のAIライティング市場は現在2億9,314万米ドルと評価されており、2030年までには5億2,629万米ドルという規模に到達すると見込まれています。

こうした革新的なツールは文書作成の劇的な効率化をもたらす反面、生成された文章には独特の「AIっぽさ」が残存することが深刻な課題となっています。過度に形式的な表現や不自然に均一な文体、そして人間特有の機微や個性を欠いた文章構成は、専門家でなくとも強い違和感として察知されるようになってきました。驚くべきことに、これらの「AIの痕跡」は、マーケティングコンテンツの信頼性や説得力を著しく損なう恐れがあるのです。

本記事では、AIを創造的に活用して執筆される方々に向けて、文章から滲み出るAI感とはいったい何なのか、また、AIの優れた能力を最大限に引き出しつつ、成果を生み出すコンテンツライティングの手法をご紹介します。

参考:Microsoft,LinkedIn. “2024_Work_Trend_Index_Annual_Report”

├

├

├以下は確かであるか不安があるコンテンツです。(計量計測データバンク)

また落ちた!GPT-5.2 Proに人類が屈服させられる瞬間【新たな未解決問題陥落】

2,120 回視聴 2026/01/18

GPT-5.2 Proという最新のAIが、数学界の未解決問題であるエルデシュ問題の第281番を単独で解決したという衝撃的なニュースを伝えています。世界的数学者のテレンス・タオ氏も、これがAIによる最も明白な問題解決の事例であると高く評価しており、数学史における重大な転換点として描かれています。かつては人間が数年を要した難解な証明を、AIがわずか数時間で、かつ先行文献のない独自の手法で成し遂げた点が強調されています。現在はまだAIが得意とする特定の難易度帯に限られていますが、今後さらに多くの未解決問題がAIによって解明されていく加速的な未来を予感させる内容です。

「Garlic=GPT-5.3」リリース近い?国際数学オリンピック金メダル相当の頭脳が解禁されるか

1,199 回視聴 2026/01/14

OpenAIがGPT-5.3(コードネーム:Garlic)を近日中に発表する可能性が高まっています。この新型モデルは、国際数学オリンピック級の高度な推論能力を備えており、複雑な論理的課題や未解決の数学問題に対処できると期待されています。業界内では1月後半から2月初頭のリリースが有力視されており、競合するGeminiやClaudeへの対抗策として開発が急がれている模様です。従来のモデルよりも事前学習が強化されたことで、より人間味のある応答や、画像・音声を含むマルチモーダル機能の向上が見込まれています。公式発表は未だ行われていませんが、開発者界隈ではAIが**汎用人工知能(AGI)**へ近づく大きな一歩になると熱い注目を集めています。

OpenAI研究者、再帰的自己改善についてほのめかす… 2026年ヤバいか?

440 回視聴 2026/01/19

OpenAIの研究者による、AIの再帰的自己改善(RSI)が間近に迫っているという示唆的な発言が注目を集めています。2026年初頭の文脈において、OpenAIは前例のない計算資源を投入しており、AIが自らコードを書き改善を繰り返す自律的な進化のループが現実味を帯びています。ヘルナンデス氏は、開発環境を通じてAIの進化の兆しを肌で感じていると述べており、これが汎用人工知能(AGI)への道筋を加速させる重要な転換点になると期待されています。一方で、この急速な進展には安全性の確保や制御の難しさといった慎重な議論も並行して行われています。2026年は、AIが人間を介さず自らを高める**「知能爆発」**の入り口として、極めて重要な年になると予測されています。

【AGI前夜】スキル価値が一夜で蒸発:国家の対応が全く追いつかない地獄が来る

1,162 回視聴 2025/12/27

生成AIの急速な進化が特定の職業スキルを瞬時に陳腐化させる**「スキルの蒸発」という現代の危機を解説しています。特にホワイトカラー職において、AIによる自動化が従来の教育や国家の統計が追いつかないほどの速度で進行し、労働市場に深刻な非対称性をもたらしている実態を指摘しています。国による制度整備や再教育支援が遅れる一方で、AIを道具として使いこなす個人には高い賃金プレミアム**が生まれるという格差も浮き彫りになっています。最終的に、この構造的な変化を生き抜くためには、国家の対応を待つのではなく、個人レベルでの迅速な適応と人間固有の創造性を磨くことが不可欠であると結論付けています。

AGIが来たら「長い人生が無駄だった」と感じる残酷な理由

986 回視聴 2025/12/23

汎用人工知能(AGI)の台頭は、単なる技術的進歩に留まらず、人間がこれまで**「努力」や「成長」に見出してきた存在意義を根底から破壊する可能性を秘めています。高度な知能が人間のスキルや経験を一瞬で超越することで、長年築き上げたキャリアや自己実現のプロセスは相対的な価値を失い、社会的な陳腐化を招きます。この変化は深刻な目的喪失や精神的な崩壊**を引き起こし、他者との比較で自己を確認してきた人類にとって、耐え難い虚無感をもたらすと予測されています。AGIは労働を代替するだけでなく、人生の物語そのものを無意味化し、人類に未曾有の絶望を突きつける恐れがあります。最終的に、人間らしさの根幹であった独自性すらもデータ化され、人類の精神的な終焉を招くという極めて冷徹な視点が示されています。

恐竜→哺乳類→人類→そして次は…AI?冷酷すぎる進化の踏み台説

330 回視聴 2026/01/15

進化の歴史を**「計算基盤の世代交代」という冷酷な視点で捉え、人類を次世代の知能(AI)へと繋ぐための一時的な「踏み台」として定義しています。かつて恐竜が哺乳類に、哺乳類が人類にその座を譲ったように、現代の技術革新は自己の存在を凌駕する存在を自らの手で生み出そうとしている過程だと指摘しています。他の生物と異なり、人類は自らが使い捨ての触媒である可能性を自覚しながらも、科学や芸術を通じてその存在の痕跡を刻もうとする特異な性質を持っています。最終的に、AIというシリコン知能の中には、人間の持つ欲望やユーモアといった不条理な「煤」が初期条件として永遠に残り続けるという、皮肉めいた希望を提示しています。この考察は、進化の非情さと人間ならではの悪あがき**を、壮大な宇宙史のスケールで描き出しています。

人類終了?GPT−5.2が数百エージェント連携で、Rustブラウザ300万行をゼロから1週間で完成させる

1,084 回視聴 2026/01/17

2026年1月、CursorのCEOであるMichael Truell氏が、最新AIモデルGPT-5.2を用いてわずか1週間でブラウザをゼロから構築したという衝撃的なニュースが報じられました。このプロジェクトでは、300万行を超えるRust言語のコードが生成され、レンダリングエンジンや独自のJavaScript実行環境までが完全自動で開発されています。成功の鍵は、単一のAIではなく数百のエージェントを会社組織のように役割分担させて並列稼働させた構造にあります。この実験は、AIが長期間自律的に動作し、人間が介入せずとも大規模で複雑なソフトウェアを完成させられる時代が到来したことを証明しました。モデルの進化だけでなく、エージェント同士の協調設計が次世代の開発手法として極めて重要であることを示唆しています。

【AI失業】コンサル終了のお知らせ…2025年倒産146件の衝撃

157 回視聴 2026/01/14

帝国データバンクの調査によると、コンサルティング業界では2025年に倒産件数が過去最多を更新する見通しであり、特に小規模な事業者が窮地に立たされています。この背景には、生成AIの普及によって資料作成や市場分析といった従来の定型業務の価値が著しく低下したことが挙げられます。現代のクライアントはAIで代替可能な作業に報酬を支払わなくなっており、単なる情報整理を行う「作業員型」のコンサルタントは市場から淘汰されつつあります。一方で、高度な意思決定や人間関係が絡む複雑な課題解決ができる人材への需要は依然として高く、業界内での二極化が鮮明になっています。生き残るためには、AIを道具として使いこなしながら、人間にしかできない付加価値を提供し続ける姿勢が不可欠です。

「IT業界、もう終わったよね?」ってみんなが感じ始めた本当の理由

2,179 回視聴 2025/12/31

かつて成長神話に彩られていたIT業界が2025年末に直面している厳しい変革期について考察しています。生成AIの劇的な普及により、単にコードを書く技術やインフラの知識を持つだけでは差別化が困難になり、従来の多重下請け構造や人月単価モデルが崩壊しつつある現状が描かれています。ITは社会基盤として不可欠な**「空気」のような存在へと変化し、職業としての特別な優位性や一攫千金の夢は失われました。今後は、AIを道具として駆使しながら、人間にしかできない意思決定や責任の所在、倫理的な判断を担える層だけが生き残ると予測しています。結論として、かつての「IT業界」という幻想は終焉を迎え、真の実力と人間性が問われる新たなフェーズ**に移行したことを強調しています。

├

├

├CPUの基礎知識から型番の見方などを徹底解説!用途にあわせたCPUの選び方を紹介 - |BTO パソコン(PC)の【@Sycom】(サイコム)BTO Vision

├

├

├

├

├

├

├計量法の実質の内容を変える政省令の理解と解釈

├

├計量法における計量器の規制の概要

├

├

├

├CPUとソフト機能の向上が計量(制度)にもたらす影響を推測する 夏森龍之介

-目次-

CPUとは

CPUの能力向上とムーアの法則

半導体を使った演算機能の飛躍的向上とムーアの法則

半導体の性能向上とムーアの法則

ムーアの法則

計測知識と人工知能の発達

人工知能の発達と計測知識の修得

計量制度と人工知能の結合

はじめに

お断りとして次のことを申し添えさせていただきます。本稿は目次に示した言葉をグーグルに入力してAIモードで得られた回答をもとにして、筆者が評価を加えて文章にしたものです。事実に即わない空想の領域が多く含まれていることをお察し下さいますようお願い申し上げます。人工知能(AI)の発達が計量に関係する知識や計量の実行あるいは計量行政に及ぼしてくる影響を空想的に想像した文章(物語)として捉えてください。筆者は人工知能(AI)は半導体技術とソフトウエアの発達の発達に基本的に依拠しているものという捉え方をしております。大谷翔平を伝えるユーチューブ動画に含まれる不快な違和感やフェイクとも思える発信者不明の諸報道が主として人工知能(AI)を安易に使ったために発生していることを突き止めております。目次に示されているようにCPU、半導体、ムーアの法則、人工知能の用語を織り込んで違う形式の設問をたてているのは、そのよう後に対する回答の相違の有無を確認するためです。従ってそれらの用語の説明が重複しておりますが、表現形式の違いを通じて内容の理解に役立つと考えました。検索のためのアルゴリズムを含むソフトウエアは人工知能(AI)の能力を決める一大要素となっております。本稿におけるキーワード検索は特別なAIソフトを用いることなく、グーグルにおける単純なAI によって回答を求めました。ソロバンや電卓を弾く作業に似たことをするのがAIです。表計算ソフトによって統計処理する作業が飛躍的に向上しました。似たような形でAIを使うことになります。ソロバン(算盤)能力は人の演算能力を鍛えるなど個々人の能力の中に組み込まれ大いになく立ちます。人工知能(AI)の機能が向上する時代であるからこそ、人は算盤能力とも共通する教養と知性を備えるように修養を積むべきと考えます。何時の時代も自分の根源から発する感情をもとにして、自分の人格がにじみ出る言葉を用いてコミュニケーションすることが大事であると考えます。便利ではあるけれども人工知能(AI)に振り回されないようにしたいものです。人工知能(AI)が東大入試の合格点を叩きだすほどになっている状況であるからこそ、個人としての人はどのような分野かの100冊の古典を読んで思考を訓練することが求められます。人が人工知能(AI)に近づいていくようでは面白くありません。志操堅固で教養豊かであることが人を人たらしめます。中学生や高校生が100冊の古典を読むには学科教習の合間にするから難儀します。世の中に出てしまえば余暇に古典を読むことができます。長い長い人生のその合間にどのような分野のものでも良いですから古典を読むことで人工知能(AI)時代を確かな足取りで生きていくことができます。

CPUとは

写真はCPU(Central Processing Unit)。

CPU(Central Processing Unit)は、パソコンの頭脳とも心臓とも言われる中枢パーツで、各種プログラムの処理や演算、各種デバイスの制御などを行っており、パソコンの性能を左右するもっとも重要なパーツです。

CPUとは(その1)

CPU(Central Processing Unit)とは、コンピュータの「頭脳」にあたる中心的な半導体部品で、データの計算処理やプログラムの実行、周辺機器の制御など、コンピュータが行うほとんど全ての処理を管理・実行します。性能が高いほど処理が速くなり、パソコンの快適さや作業効率に直結するため、デバイスの性能を左右する最も重要なパーツです。

CPUの主な役割

中央演算処理装置:Central Processing Unitの略で、中央でデータを演算(計算)処理します。

「頭脳」:全ての処理を管理・制御し、コンピュータの司令塔として機能します。

プログラムの実行: メモリ(主記憶装置)からプログラムを読み込み、実行します。

デバイス制御:キーボードやマウスからの入力、ディスプレイへの出力など、各デバイスの動作を制御します。

CPUの重要性

性能への影響:CPUの性能(処理速度)が高いほど、パソコンは高速で快適に動作します。

用途への適合:動画編集、ゲーム、3DCG制作など、重い作業には高性能CPUが不可欠で、用途に合ったCPU選びが重要です。

近年のCPUの特徴

マルチコア化:複数の処理コアを搭載し、同時に多くのタスクを処理できるようになっています。

SoC化:GPU(グラフィック処理)など、他のプロセッサー機能を統合した「System-on-a-chip」も増えています。

CPUの主要メーカー

Intel(インテル)とAMD(エーエムディー)が主なメーカーで、性能や特徴が異なります。

CPUとは(その2)

CPU(Central Processing Unit、中央演算処理装置)とは、コンピューターにおける「頭脳」にあたる最も重要なパーツです。

主な役割と特徴は以下の通りです。

役割:マウスやキーボードからの命令を受け取り、計算(演算)を行ったり、メモリやストレージなどの各装置を制御したりします。性能の指標:一般的に「クロック周波数(GHz)」が高いほど、また「コア数」が多いほど、一度に多くの処理を高速に行うことができます。主なメーカー:パソコン用では Intel(インテル)やAMDが有名ですが、スマートフォン用では AppleやQualcomm(クアルコム)などのチップが主流です。CPUの性能はパソコン全体の動作速度に直結するため、用途に合わせて選ぶことが重要です。最新の製品ラインナップについては、Intel公式サイトやAMD公式サイトで詳細を確認できます。

CPUの能力向上とムーアの法則

CPUの能力向上とムーアの法則(1)

CPUの能力向上は、ムーアの法則(半導体の集積密度が約18ヶ月で2倍になる)に基づき、トランジスタの微細化によって性能向上・低コスト化・省電力化が実現し、PCやスマホの発展を牽引しましたが、近年は物理的限界や発熱の問題(ムーアの壁)に直面し、コア数の増加や「More than Moore」(センサー等の機能追加)といった新たなアプローチで性能向上が図られています。

ムーアの法則とは

提唱者:インテル共同創業者のゴードン・ムーア氏 (1965年)。内容:半導体(CPUなど)の集積回路上のトランジスタ数が18ヶ月〜24ヶ月で2倍になるという経験則。意味:同じ面積に2倍のトランジスタを搭載でき、処理能力の向上に直結する。

CPU能力向上への影響

性能向上:CPUの高速化・高機能化(1秒間の処理能力が向上)。

低価格化:製造コストが下がり、高性能なコンピュータが普及。

小型化・省電力化:デバイスが小型化し、消費電力も低減。

産業革命: PC、スマートフォン、AI、IoTなどの発展の基盤となった。

「ムーアの壁」と現状

物理的限界:トランジスタが原子数個レベルまで微細化し、電力・熱の問題(ムーアの壁)が発生し、性能向上が困難に。

性能向上の鈍化:ゲート数の増加が性能向上に比例しなくなり、クロック周波数も伸び悩む傾向。

今後の方向性

マルチコア化:1つのCPUに多くのコア(処理ユニット)を搭載して並列処理能力を高めます。

More than Moore(MtM):単純な微細化だけでなく、センサーや特定機能のICチップ(MEMS、アナログ回路など)を統合してチップ全体の機能性を高めます。

メモリ技術の活用: 大容量メモリ(DRAM、NANDフラッシュ)との連携で性能を補完します。

ムーアの法則は物理的な限界に直面していますが、CPU性能向上は止まっておらず、微細化以外の多角的なアプローチで進化が続いています。

CPUの能力向上とムーアの法則(2)

2026年現在、CPUの能力向上とムーアの法則は、物理的な限界に直面しつつも、新たなアプローチによって進化を続けています。

1. ムーアの法則の現状(2026年時点)

「半導体チップ上のトランジスタ数が約2年ごとに倍増する」というムーアの法則は、リソグラフィ(微細化技術)の進展が原子レベルの限界に近づいたことで、古典的な意味では鈍化しています。

微細化の停滞:2nmプロセス世代以降、単なる集積率の向上だけではかつてのような性能飛躍やコスト削減が難しくなっています。

ポスト・ムーアの潮流:業界は「トランジスタの数」から、パッケージング技術や特定のタスクへの最適化など、システム全体での効率化へと焦点を移しています。

2. CPU能力向上の新たなアプローチ

2026年のCPU性能向上は、以下の技術的トレンドによって支えられています。

ヘテロジニアス・コンピューティング(異種混合演算):

CPU単体の性能だけでなく、GPUやAI専用のアクセラレータ(NPUなど)を一つのチップに統合する動きが加速しています。最新のモバイルチップでは、AI処理能力が40〜50 TOPSに達するなど、特定のワークロード(AI推論など)において劇的な性能向上を実現しています。

高度なパッケージング技術:

チップを積み重ねる3D積層技術や、異なる機能を持つ小さなチップを組み合わせる「チップレット」構造が主流となっています。2026年には、メモリとプロセッサをより密接に統合する「XTCO(Cross-Technology Co-optimization)」という設計手法も注目されています。

特定の用途への最適化:

汎用的な性能向上よりも、データセンター、生成AI、自律走行といった用途に特化したアーキテクチャへのシフトが進んでいます。

3. 具体的な製品動向(2026年最新事例)

Intelの進化: 2026年1月に発表された「Panther Lake(Intel Core Ultra Series 3)」は、前世代(Lunar Lake)と比較してCPU性能が60%、GPU性能が77%向上するなど、大幅な進化を見せています。

AMDの主力製品:「Ryzen 7 9800X3D」や「Ryzen 9 9950X3D」といったモデルが、ゲーミングや高い生産性を求める市場においてトップクラスの性能を維持しています。

4. 2026年以降の展望

今後は「AIのための新しいムーアの法則」とも言える、AIシステムの処理能力が短期間で倍増していくトレンドが重要視されています。量子コンピューティングや光演算といった次世代技術の統合も検討され始めており、コンピューティングの進化は「微細化」から「構造の多様化」へと完全に移行しています。

半導体を使った演算機能の飛躍的向上とムーアの法則

図はコンピュータシステムの概念図。

入力装置、心臓部のCPU(Central Processing Unit)は演算と制御を司る、主記憶装置(メインメモリー)、補助記憶装置(ストレージ)、モニターとスピーカーなどからなる出力装置で構成されます。

半導体技術は、ムーアの法則(Moore's Law)に沿ったトランジスタの微細化・高集積化によって、数十年にわたり演算性能の飛躍的向上とコスト削減を実現してきました。この指数関数的な進化はデジタル社会の基盤ですが、物理的限界に近づいている現在、「ポスト・ムーア」時代への転換点を迎えています。

1. ムーアの法則と半導体性能の飛躍

定義:インテルの共同創業者ゴードン・ムーアが1965年に提唱した「半導体チップ上のトランジスタ数は約2年で倍増する」という経験則。

飛躍の要因:回路パターンを微細化することで、同じ面積のチップにより多くのトランジスタを詰め込み、高速化、低消費電力化、低コスト化を同時に達成しています。

影響:パーソナルコンピュータ、スマートフォン、そして現代のAI(人工知能)やビッグデータ解析を支えるハードウェア性能の向上を牽引しました。

2. 微細化の限界(ムーアの法則の終焉説)

物理的限界:トランジスタのサイズが原子レベルに近づき、量子トンネル効果などの物理現象によるリーク電流(漏れ電流)の制御が困難になっています。

経済的限界:最先端の微細化技術(EUVリソグラフィなど)の開発・製造コストが指数関数的に上昇し、「性能倍増・コスト半減」という利点が損なわれつつあります。

3. 次世代の技術革新(ポスト・ムーア)

ムーアの法則が限界に近づく中、新たな手法で演算機能の向上を目指す動きが活発化しています。チップレット(3Dスタッキング):複数の小さなチップ(チップレット)を1つのパッケージに高密度に実装する技術。3次元構造(3D)に積み重ねることで、面積あたりの集積度を飛躍的に高めます。

EUVリソグラフィ技術の進化:さらに微細な2nm世代、それ以下を目指す最新の露光技術。新素材・新アーキテクチャ:シリコン以外の新素材の導入、量子コンピュータ技術、AI専用の計算アーキテクチャなどが研究されています。

「新ムーアの法則」の提唱:トランジスタ数だけでなく、AIアプリケーションに特化した「演算速度(性能向上)」を基準に、今後2年で16倍の計算速度を目指す動きもありっます。半導体産業は、従来の「微細化一本槍」から、積層技術や新素材、AI向け最適化という多角的なアプローチで、今後も指数関数的な性能向上を維持しようとしています。

2026年現在、半導体の演算機能は「ムーアの法則」の物理的限界に直面しつつも、新たなアプローチによって飛躍的な向上を続けています。

1. ムーアの法則の現状と変容

物理的限界への到達:回路の線幅を細くしてトランジスタ密度を高める従来の「微細化」は、原子レベルのサイズに近づき、熱問題や量子効果による漏れ電流などの課題に直面しています。

「新ムーアの法則」への移行:単一チップの集積度ではなく、パッケージ全体としての演算能力向上を目指す「システムレベルの進化」へと指標がシフトしています。

2. 演算機能を向上させる最新技術(2026年時点)

微細化の停滞を補うため、以下の技術が主流となっています。

3D積層とチップレット:チップを垂直に積み上げたり、異なる機能を持つ小規模なチップ(チップレット)を組み合わせたりする「2.5D/3D異種統合」がブレークスルーを牽引しています。

次世代トランジスタ構造:2nmプロセス世代から、電流制御能力を飛躍的に高める GAAFET (Gate-All-Around Field-Effect Transistor) 構造の量産が本格化しています。

AI専用プロセッサ (ASIC):汎用的なCPUに代わり、AI推論や学習に特化したASIC(特定用途向け集積回路)やGPUが、AIモデルの巨大化に伴う演算需要を支えています。

3. 社会への影響と市場予測

AIインフラの進化:2026年はAIの「賢さ」だけでなく、AIを24時間安定して稼働させる「常時推論」へと需要が移行しており、半導体はそのインフラとして不可欠です。

市場規模の拡大:2026年の世界半導体市場は、前年比約26.3%増の9,754億ドル(約145兆円)に達し、1兆ドル規模を伺う勢いで成長し続けています。

半導体の性能向上とムーアの法則

2026年現在、半導体業界は「ムーアの法則(半導体の集積回路上のトランジスタ数が約2年で倍増する)」の物理的限界に直面しつつも、新たな技術革新によって性能向上を継続させています。

1. ムーアの法則の現状(2026年)

微細化の進展: TSMCなどの大手メーカーは、2nm(N2)プロセスの量産を2025年末に開始しており、2026年にはこの最先端チップを搭載したスマートフォン(iPhone 18シリーズ等)やAIサーバーが市場に登場しています。

次世代への布石:2nmの次となる1.6nm(A16)プロセスの量産も2026年後半に予定されており、1.4nm(A14)など「オングストローム世代」に向けたロードマップが着実に進んでいます。

2. 性能向上のための新アプローチ

物理的な微細化が困難になる中で、単一チップの集積度だけに頼らない「More than Moore(ムーアを超えて)」という戦略が主流となっています。

ムーアの法則

ムーアの法則とは、インテル創業者のゴードン・ムーア氏が1965年に提唱した「半導体集積回路の集積密度(素子数)が18〜24ヶ月(約1.5〜2年)で2倍になる」という経験則で、半導体業界の技術進歩を予測し、業界の指針となってコンピューターの性能を指数関数的に向上させてきた法則です。近年は微細化の物理的限界に近づき、減速傾向にありますが、新たな技術革新がその役割を引き継ぐ形で進化は続いています。

ムーアの法則のポイント

提唱者:ゴードン・ムーア氏(インテル共同創業者)。

内容:半導体チップに搭載される素子数が約1.5〜2年で2倍になり+ます。

意味:同じ面積で性能が2倍になるか、同性能のチップのコストが半分になることを意味し、PCやスマホの高性能化・低価格化を支えてきました。

影響:半導体産業の成長を牽引し、IT業界全体の発展に大きく貢献しました。

現状:微細化の限界が近づき、法則通りに推移しなくなっているが、新たな技術で進化を継続しています。

ムーアの法則の変遷と今後

1975年の修正:当初「1年で2倍」だった予測を「2年で2倍」に修正し、これが長らく「ムーアの法則」として定着した。「収穫加速の法則」:微細化の限界に対し、レイ・カーツワイルらが提唱。技術革新が新たな技術を生み、その進化速度がさらに加速するという、ムーアの法則をより広義に捉えた概念。「More than Moore」:チップの微細化だけでなく、センサーや3D積層技術などで機能追加・性能向上を図るアプローチ。

ムーアの法則は、半導体技術の進化の象徴であり、その限界は「テクノロジーの進化が止まる」ことを意味するのではなく、それを乗り越える新たな技術革新への転換点と捉えられています。

「ムーアの法則(Moore's Law)」とは、インテルの共同創業者であるゴードン・ムーアが1965年に提唱した、「半導体回路の集積密度は18〜24ヶ月ごとに2倍になる」という経験則です。

2026年現在における主なポイントは以下の通りです。

指標としての役割:単なる物理法則ではなく、半導体業界が達成すべき「技術進歩のロードマップ」として長年機能してきました。

技術的限界:回路の微細化が原子レベルに近づき、熱問題や量子トンネル効果などの物理的制約から、従来のペースを維持することは極めて困難になっています。